MYSQLLeftJoin优化(10秒优化到20毫秒内)

本篇文章给大家分享《MYSQLLeftJoin优化(10秒优化到20毫秒内)》,覆盖了数据库的常见基础知识,其实一个语言的全部知识点一篇文章是不可能说完的,但希望通过这些问题,让读者对自己的掌握程度有一定的认识(B 数),从而弥补自己的不足,更好的掌握它。

结合工作中的内容和大家分享一次Left Jon优化的过程,希望能给同学们新的思路。

【功能背景】

我们需要按照用户订单号和商户号统计出购买的商品数量和售后的商品数量。涉及到的表和关系见下图:

很不幸工程师在起初进行表结构设计的时候没有在商户订单表中记录下购买的商品总数,在商户订单的售后单中也没记录下售后的商品数量。

【原始的SQL】

select o.no,s_order.no,sum(s_item.count),sum(after_sale_item.count) from buyer_order o left join seller_order s_order on o.id = s_order.buyer_order_id left join seller_order_item s_item on s_order.id = s_item.seller_order_id left join seller_order_after_sale after_sale on s_order.id = after_sale.seller_order_id left join seller_order_after_sale_item after_sale_item on after_sale.id = after_sale_item.after_sale_id where o.add_time >='2019-05-01' group by o.id,s_order.id order by o.id limit 0,10

以上SQL几个关键字段都使用了索引。

【原始的SQL分析】

这是一条很常规的SQL,逻辑上也没什么毛病

这条SQL中有较多的连接查询,如果随着售后单的增加,连接的数据就会更多

将符合条件的数据都加载到内存后按照 order.id,s_order.id 进行分组统计,如果有100W的数据会怎样?如果你用代码去实现这么一段统计你会怎么做?

将统计完的数据再按照 order.id 进行排序,取出前10条数据。

从以上的SQL发现需要将符合条件的所有的数据加载到内存后要进行分组,统计,排序,最后再进行分页。我们能不能减少数据的加载数量呢?能不能减少数据库CPU的使用量,能不能先取少量的数据再统计呢?

基于以上的问题,我们进行了优化

【分析步骤】

作为旁观者一开始不了解我们功能需要输出什么样的数据,所以我们一开始要了解每张表存储的是什么样的数据,彼此之间的关系是什么。

我们忘记原来的SQL是什么样的,按照我们需要的数据,再次重新的思考,不要再陷入原来的SQL的漩涡中。

针对上面提出的问题,如何减少数据的加载?能不能先分页数据,再对分页的数据进行单独的统计呢?

那么我们是不是需要对group by进行优化,我们要想办法先分页

大家是否想到了一些方法?

【优化后的SQL】

select

o.id,o.no,s_order.no,

(select sum(sot.count) from seller_order so

left join seller_order_item sot on so.id = sot.seller_order_id

where so.id =s_order.id ),

(select sum(osat.count) from seller_order_after_sale osa

left join seller_order_after_sale_item osat on osa.id = osat.after_sale_id

where osa.seller_order_id = s_order.id )

from

buyer_order o

left join seller_order s_order on o.id = s_order.buyer_order_id

where o.addTime >='2019-05-01'

order by

o.id

limit 0,10

【优化的SQL分析】

- 很直观的发现,我们把group by去掉了,因为按照 order.id,s_order.id 分组,实际只对 buyer_order和seller_order表进行连接,逻辑上是一样的进行了分组。

- group by不使用的话我们就减少了CPU对数据分组的处理,而且我们只连接主要的表数据,减少了加载到内存中的数据。

- 以上的操作就完成了我们之前说的先对数据分页。我们取出了10条数据。

- 接着我们再对10条数据的销售出去的商品数量和售后的数量进行统计

- 这时候大家发现,我们其实只对分页出来的10条数据进行统计,原来是将所有的数据分组统计后取10条。可以发现我们这样操作大大减少了对数据的统计处理。我们只需要统计我们需要的数据。

以上优化的效果可能远远超出大家的想象。

实际工作中连表的数比我们例子中的要多,未优化的SQL在执行未分页的时候发现一共有70万的数据,我们分页取出10条数据花了10+秒以上的时间,数据量不大但是大部分的时间都消耗在了分组和数据统计,大家可以试着写一段代码对这些数据进行分组和统计,就能明白其中的复杂性。

而实际上无论取出10条和全部取出,时间基本上一样的(不考虑IO),因为先进行了统计。

优化后的SQL,加载到内存中只有2万左右的数据,而且不进行统计,先取出10条数据,然后再对10条数据进行统计,逻辑上比之前的简单多了。优化后的SQL执行时间在20毫秒以内。

其实如果在订单表和售后表都记录了对应的数量,连表数还要少,还不需要进行子查询。有时候设计表的时候还是需要考虑一下统计的需要。

文中关于mysql的知识介绍,希望对你的学习有所帮助!若是受益匪浅,那就动动鼠标收藏这篇《MYSQLLeftJoin优化(10秒优化到20毫秒内)》文章吧,也可关注golang学习网公众号了解相关技术文章。

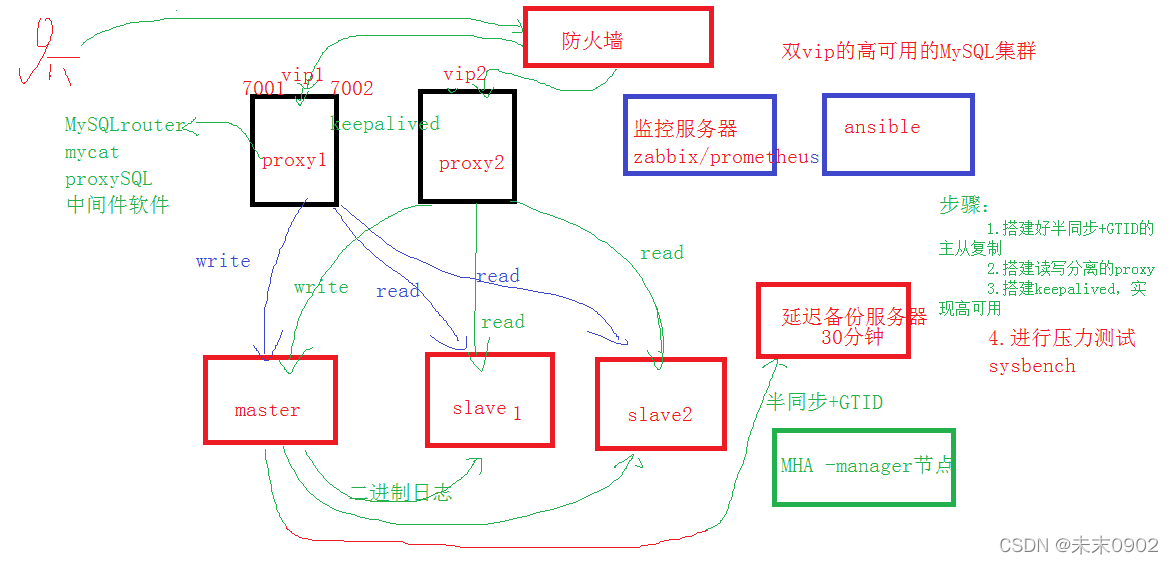

构建双vip的高可用MySQL集群

构建双vip的高可用MySQL集群

- 上一篇

- 构建双vip的高可用MySQL集群

- 下一篇

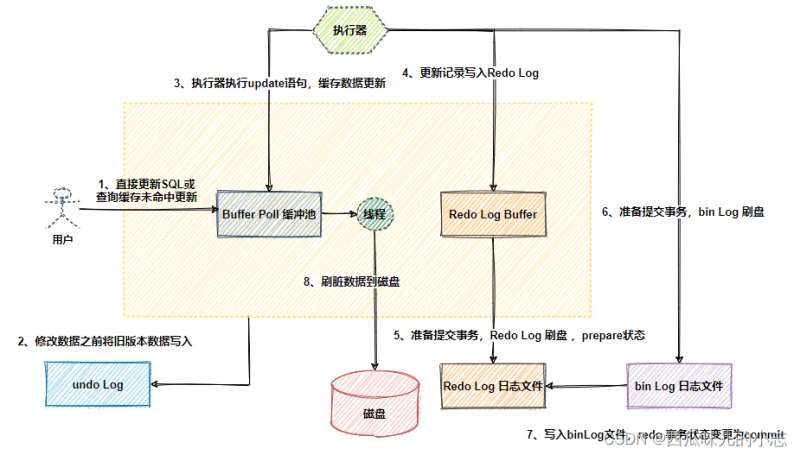

- Mysql数据库面试必备之三大log介绍

-

- 英勇的唇膏

- 太给力了,一直没懂这个问题,但其实工作中常常有遇到...不过今天到这,帮助很大,总算是懂了,感谢老哥分享文章内容!

- 2023-06-07 11:12:18

-

- 高兴的魔镜

- 太细致了,码住,感谢大佬的这篇文章,我会继续支持!

- 2023-04-25 10:23:16

-

- 魁梧的乌冬面

- 这篇文章太及时了,细节满满,写的不错,码起来,关注作者了!希望作者能多写数据库相关的文章。

- 2023-04-24 21:00:22

-

- 坦率的黄豆

- 受益颇多,一直没懂这个问题,但其实工作中常常有遇到...不过今天到这,看完之后很有帮助,总算是懂了,感谢大佬分享技术文章!

- 2023-03-17 02:27:36

-

- user_1671454250

- 写的不错,一直没懂这个问题,但其实工作中常常有遇到...不过今天到这,帮助很大,总算是懂了,感谢up主分享技术文章!

- 2023-03-04 16:47:59

-

- 喜悦的战斗机

- 这篇技术文章真是及时雨啊,太详细了,感谢大佬分享,已收藏,关注up主了!希望up主能多写数据库相关的文章。

- 2023-02-25 06:40:16

-

- 从容的可乐

- 这篇文章内容太及时了,太详细了,受益颇多,已收藏,关注师傅了!希望师傅能多写数据库相关的文章。

- 2023-02-24 00:58:34

-

- 数据库 · MySQL | 1天前 |

- MySQL数据归档方法与工具详解

- 127浏览 收藏

-

- 数据库 · MySQL | 5天前 |

- MySQL优化Join查询的方法及常见Join策略解析

- 414浏览 收藏

-

- 数据库 · MySQL | 6天前 |

- MySQL数据备份方法及常用策略

- 105浏览 收藏

-

- 数据库 · MySQL | 1星期前 |

- MySQL存储引擎是什么?作用有哪些?

- 166浏览 收藏

-

- 数据库 · MySQL | 2星期前 |

- MySQL创建数据库的完整步骤详解

- 287浏览 收藏

-

- 数据库 · MySQL | 2星期前 |

- MySQL创建数据库及字符集设置方法

- 159浏览 收藏

-

- 数据库 · MySQL | 1个月前 |

- MySQL常用数据类型有哪些及如何选择

- 187浏览 收藏

-

- 数据库 · MySQL | 1个月前 |

- MySQL查询缓存如何开启?有什么好处?

- 285浏览 收藏

-

- 数据库 · MySQL | 1个月前 |

- MySQL创建数据库全流程详解

- 370浏览 收藏

-

- 数据库 · MySQL | 2个月前 |

- MySQL建库建表完整步骤详解

- 106浏览 收藏

-

- 数据库 · MySQL | 2个月前 |

- MySQL权限管理设置全攻略

- 501浏览 收藏

-

- 数据库 · MySQL | 2个月前 |

- MySQL事务是什么?如何保证数据一致性?

- 276浏览 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 5902次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 6331次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 6141次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 8113次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 6619次使用

-

- 分析Go错误处理优化go recover机制缺陷

- 2023-01-01 483浏览

-

- gozero微服务高在请求量下如何优化

- 2023-01-01 268浏览

-

- Go 内联优化让程序员爱不释手

- 2023-01-07 177浏览

-

- MySQL 8.0 对 limit 的优化技巧

- 2023-01-07 130浏览

-

- MySQL8.0 索引优化invisible index详情

- 2023-01-07 309浏览