ChatGPT Java:如何实现智能语音识别和转写功能

2023-10-24 08:18:45

0浏览

收藏

IT行业相对于一般传统行业,发展更新速度更快,一旦停止了学习,很快就会被行业所淘汰。所以我们需要踏踏实实的不断学习,精进自己的技术,尤其是初学者。今天golang学习网给大家整理了《ChatGPT Java:如何实现智能语音识别和转写功能》,聊聊,我们一起来看看吧!

ChatGPT Java:如何实现智能语音识别和转写功能,需要具体代码示例

引言:

随着人工智能技术的不断发展,智能语音识别和转写成为了越来越受关注的研究领域。实现智能语音识别和转写功能能够广泛应用于语音助手、语音输入法、智能客服等领域,为用户提供便捷的语音交互体验。本文将介绍如何使用Java实现智能语音识别和转写功能,并提供具体的代码示例。

导入依赖

首先,我们需要导入相关的依赖项。在Java项目的pom.xml文件中添加以下依赖项:org.eclipse.jetty.websocket javax.websocket-api 1.0 org.java-websocket Java-WebSocket 1.5.1 com.google.cloud google-cloud-speech 2.3.2 - 创建WebSocket服务器

在Java中,我们可以使用Java-WebSocket库来创建WebSocket服务器。创建一个名为WebSocketServer的类,并继承自Java-WebSocket库中的WebSocketServer类。在WebSocketServer类中实现onOpen、onClose、onMessage和onError等方法,并创建一个WebSocket连接。

import org.java_websocket.WebSocket;

import org.java_websocket.handshake.ClientHandshake;

import org.java_websocket.server.WebSocketServer;

import java.net.InetSocketAddress;

public class SpeechRecognitionServer extends WebSocketServer {

public SpeechRecognitionServer(InetSocketAddress address) {

super(address);

}

@Override

public void onOpen(WebSocket conn, ClientHandshake handshake) {

// 连接建立时的处理逻辑

}

@Override

public void onClose(WebSocket conn, int code, String reason, boolean remote) {

// 连接关闭时的处理逻辑

}

@Override

public void onMessage(WebSocket conn, String message) {

// 接收到消息时的处理逻辑

}

@Override

public void onError(WebSocket conn, Exception ex) {

// 异常处理逻辑

}

}- 创建语音识别服务

接下来,我们需要使用Google Cloud Speech-to-Text API来实现语音识别功能。在SpeechRecognitionServer类中添加一个startRecognition方法。通过该方法,我们可以将音频数据发送到Google Cloud Speech-to-Text API,并获得识别结果。

import com.google.cloud.speech.v1.*;

import com.google.protobuf.ByteString;

import java.io.IOException;

import java.nio.file.Files;

import java.nio.file.Path;

import java.nio.file.Paths;

import java.util.List;

public class SpeechRecognitionServer extends WebSocketServer {

private SpeechClient speechClient;

public SpeechRecognitionServer(InetSocketAddress address) {

super(address);

try {

// 创建SpeechClient实例

this.speechClient = SpeechClient.create();

} catch (IOException e) {

e.printStackTrace();

}

}

public void startRecognition(byte[] audioData) {

// 构建RecognitionConfig对象

RecognitionConfig config = RecognitionConfig.newBuilder()

.setEncoding(RecognitionConfig.AudioEncoding.LINEAR16)

.setSampleRateHertz(16000)

.setLanguageCode("en-US")

.build();

// 构建RecognitionAudio对象

RecognitionAudio audio = RecognitionAudio.newBuilder()

.setContent(ByteString.copyFrom(audioData))

.build();

// 发送语音数据并获取识别结果

RecognizeResponse response = speechClient.recognize(config, audio);

List results = response.getResultsList();

for (SpeechRecognitionResult result : results) {

System.out.println(result.getAlternatives(0).getTranscript());

}

}

} - 进行语音转写

最后,我们需要在onMessage方法中处理接收到的音频数据,并调用startRecognition方法进行语音转写。同时,我们还需要在onClose方法中关闭SpeechClient实例。

import org.java_websocket.WebSocket;

import org.java_websocket.handshake.ClientHandshake;

import org.java_websocket.server.WebSocketServer;

import java.net.InetSocketAddress;

public class SpeechRecognitionServer extends WebSocketServer {

private SpeechClient speechClient;

public SpeechRecognitionServer(InetSocketAddress address) {

super(address);

try {

// 创建SpeechClient实例

this.speechClient = SpeechClient.create();

} catch (IOException e) {

e.printStackTrace();

}

}

@Override

public void onOpen(WebSocket conn, ClientHandshake handshake) {

// 连接建立时的处理逻辑

}

@Override

public void onClose(WebSocket conn, int code, String reason, boolean remote) {

// 连接关闭时的处理逻辑

try {

// 关闭SpeechClient实例

speechClient.close();

} catch (IOException e) {

e.printStackTrace();

}

}

@Override

public void onMessage(WebSocket conn, String message) {

// 接收到消息时的处理逻辑

byte[] audioData = decodeAudioData(message);

startRecognition(audioData);

}

@Override

public void onError(WebSocket conn, Exception ex) {

// 异常处理逻辑

}

private void startRecognition(byte[] audioData) {

// 构建RecognitionConfig对象

RecognitionConfig config = RecognitionConfig.newBuilder()

.setEncoding(RecognitionConfig.AudioEncoding.LINEAR16)

.setSampleRateHertz(16000)

.setLanguageCode("en-US")

.build();

// 构建RecognitionAudio对象

RecognitionAudio audio = RecognitionAudio.newBuilder()

.setContent(ByteString.copyFrom(audioData))

.build();

// 发送语音数据并获取识别结果

RecognizeResponse response = speechClient.recognize(config, audio);

List results = response.getResultsList();

for (SpeechRecognitionResult result : results) {

System.out.println(result.getAlternatives(0).getTranscript());

}

}

private byte[] decodeAudioData(String message) {

// 解码音频数据

// TODO: 解码逻辑

return null;

}

} 总结:

本文介绍了如何使用Java实现智能语音识别和转写功能。我们首先导入了相关的依赖项,然后使用Java-WebSocket创建了一个WebSocket服务器,并在其中实现了基本的WebSocket连接处理逻辑。接着,我们使用Google Cloud Speech-to-Text API来实现语音识别功能,并通过WebSocket连接接收音频数据进行转写。最后,我们提供了具体的代码示例,帮助读者更好地理解和实践智能语音识别和转写功能的实现。希望本文能够对读者有所帮助。

本篇关于《ChatGPT Java:如何实现智能语音识别和转写功能》的介绍就到此结束啦,但是学无止境,想要了解学习更多关于文章的相关知识,请关注golang学习网公众号!

如何结合ChatGPT PHP实现在线客服功能?

如何结合ChatGPT PHP实现在线客服功能?

- 上一篇

- 如何结合ChatGPT PHP实现在线客服功能?

- 下一篇

- CSS布局技巧:实现屏幕折叠效果的最佳实践

查看更多

最新文章

-

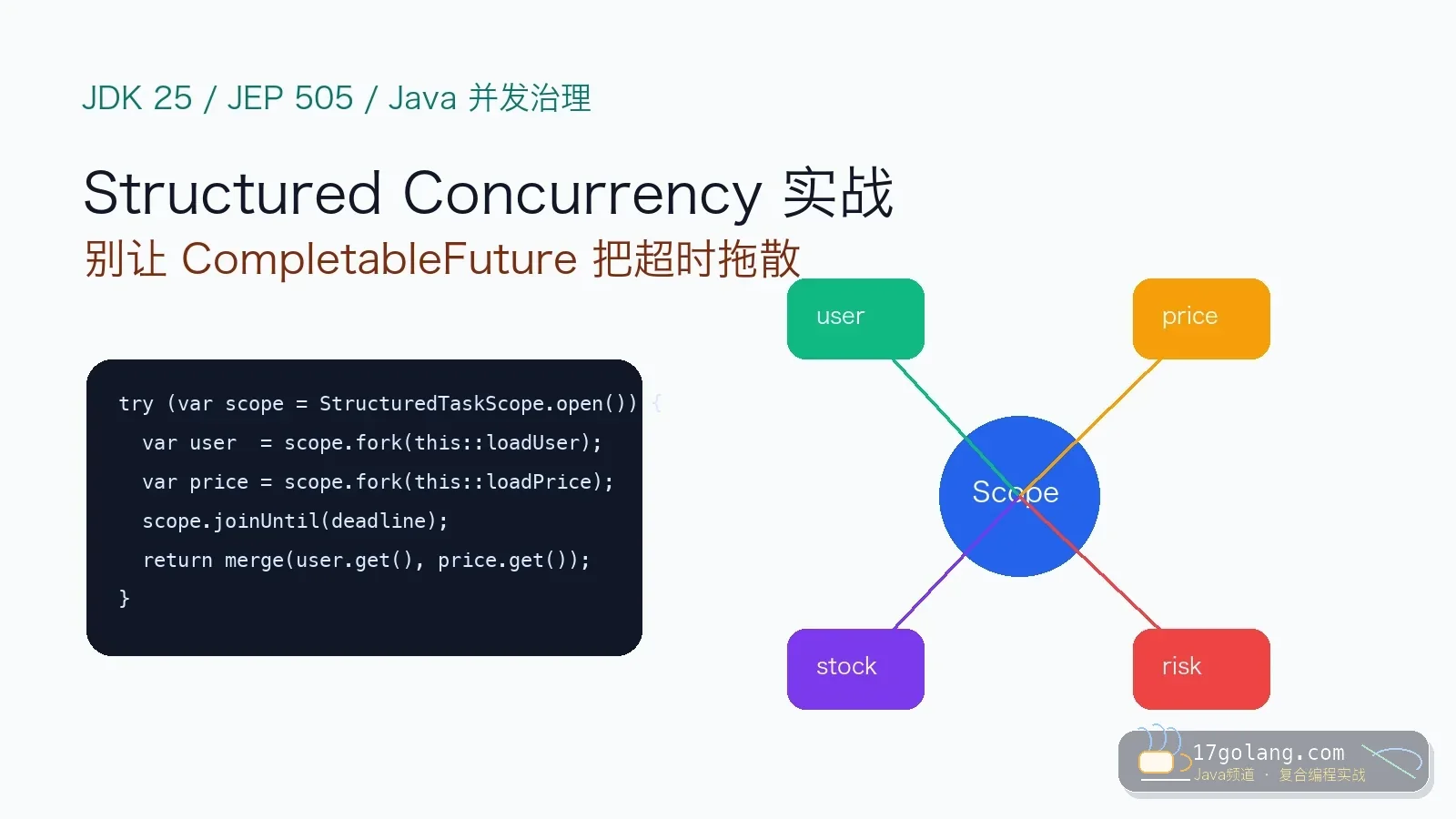

- 文章 · java教程 | 1小时前 | 并发编程 · 生产实践 · Java教程 · JDK25 · 虚拟线程 · 虚拟线程 Java 25 JEP 505 Structured Concurrency StructuredTaskScope

- Java 25 Structured Concurrency 实战:别让 CompletableFuture 把超时拖散

- 443浏览 收藏

-

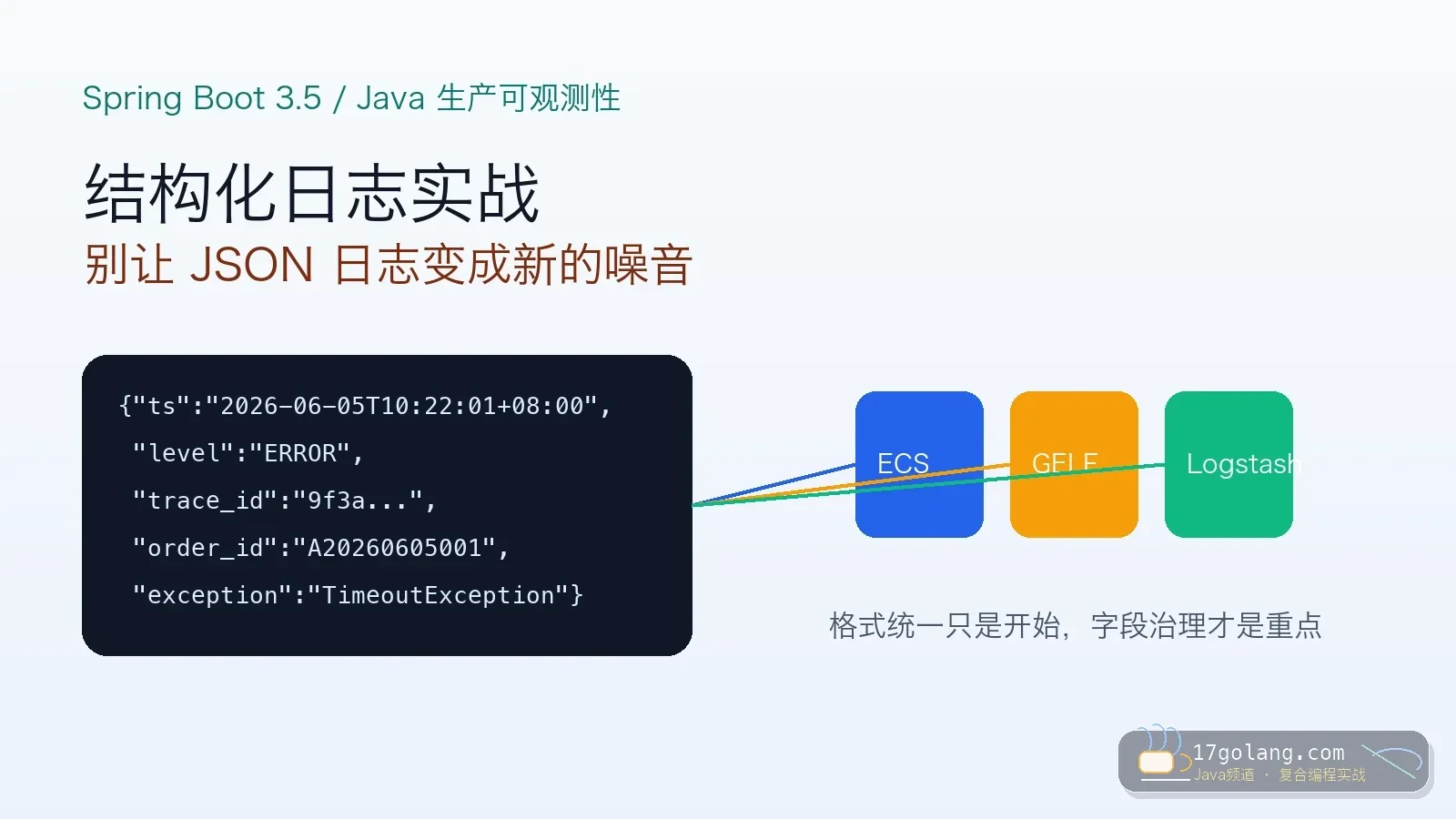

- 文章 · java教程 | 3天前 | 日志 · Spring Boot · 生产实践 · 可观测性 · Java教程 · java 可观测性 MDC 结构化日志 Spring Boot 3.5

- Spring Boot 3.5 结构化日志实战:别让 JSON 日志变成新的噪音

- 332浏览 收藏

-

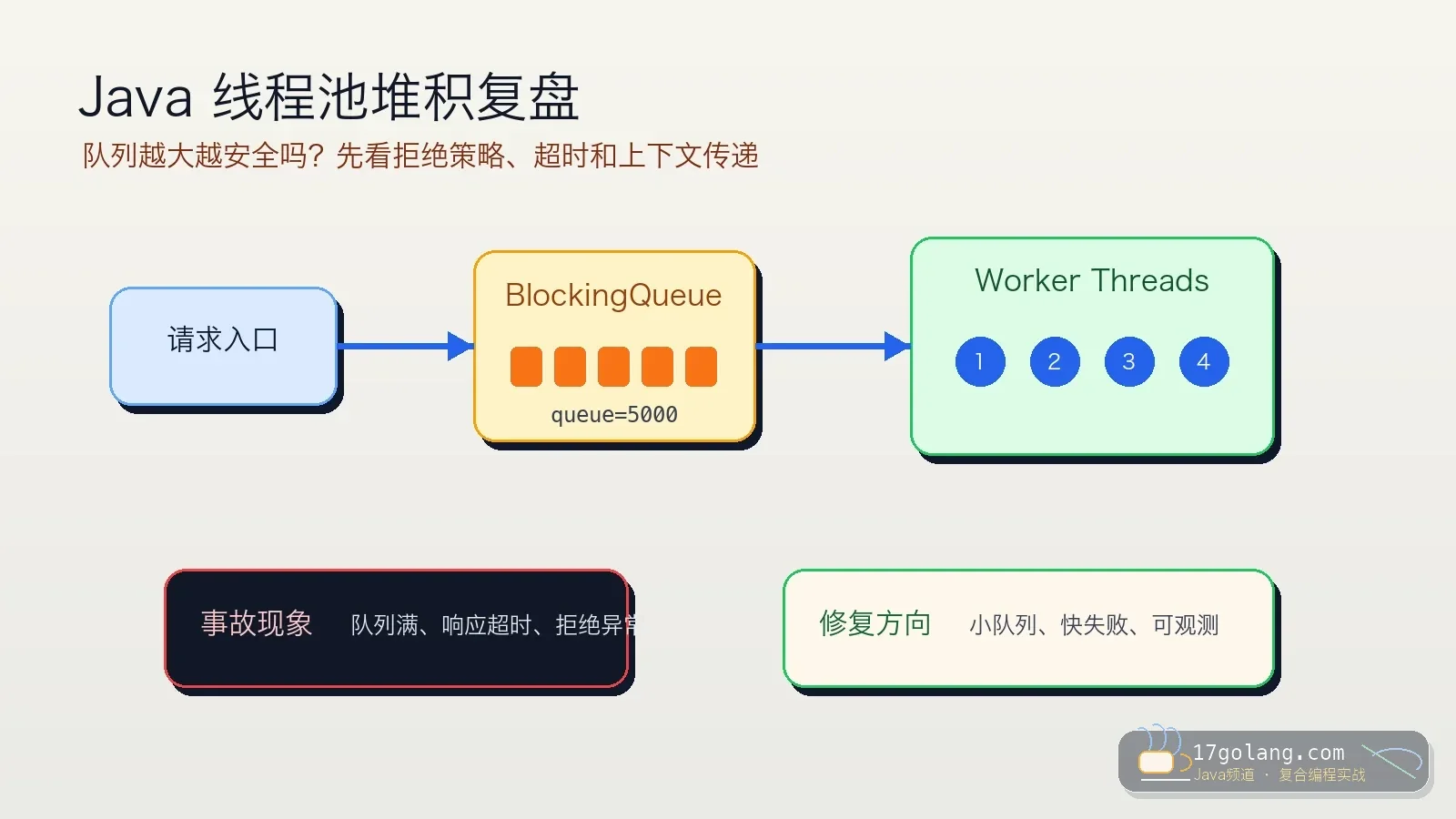

- 文章 · java教程 | 4天前 | 线程池 · Spring Boot · 生产实践 · Java教程 · ThreadPoolExecutor · java 性能优化 线程池 spring boot threadpoolexecutor

- Java 线程池队列堆积复盘:别让无界队列把慢故障藏起来

- 326浏览 收藏

-

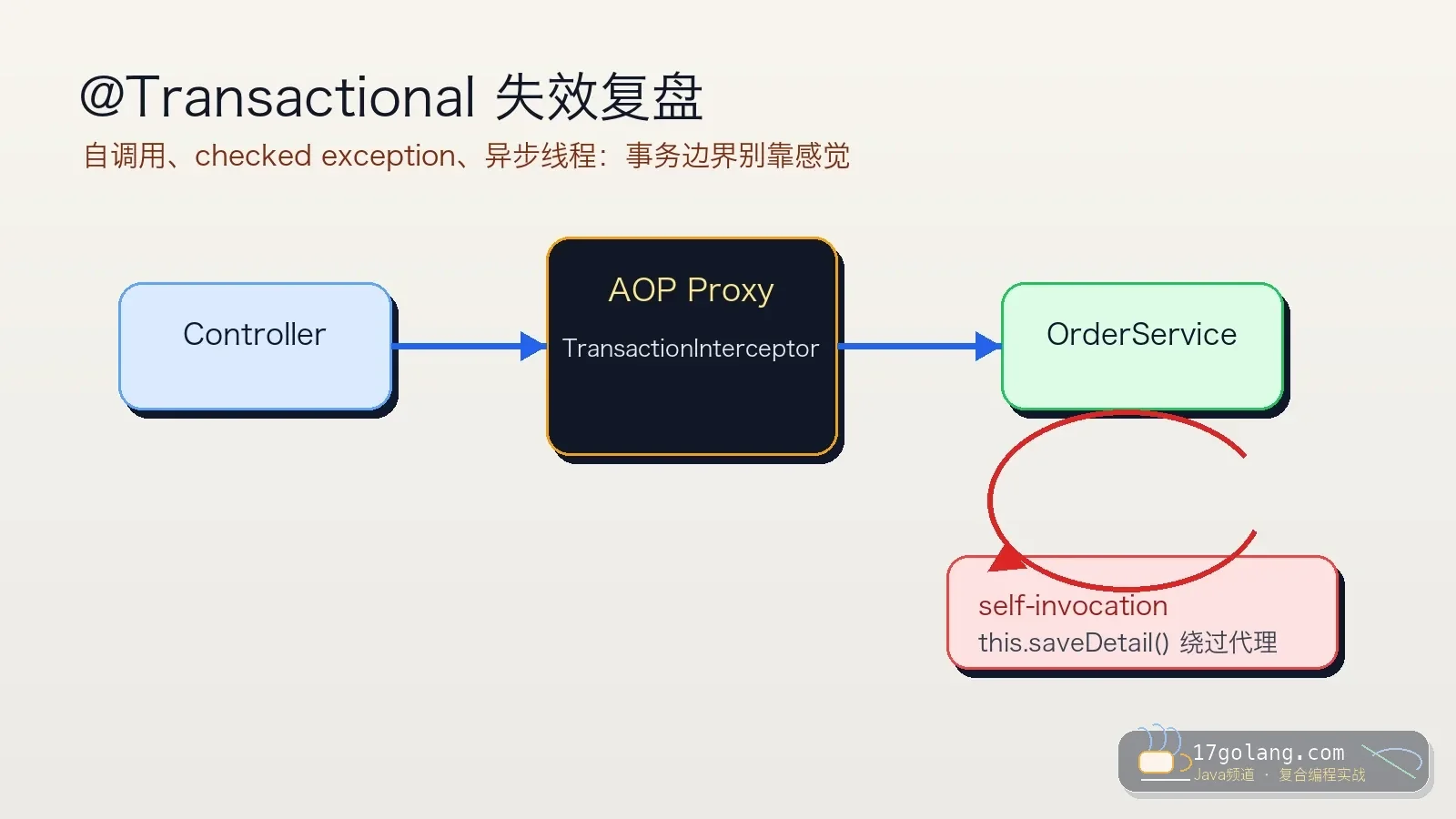

- 文章 · java教程 | 4天前 | Spring Boot · 事务管理 · 生产实践 · Java教程 · Transactional · java 事务管理 spring boot 生产实践 Transactional

- @Transactional 失效复盘:自调用、异常回滚和异步线程别再踩坑

- 259浏览 收藏

-

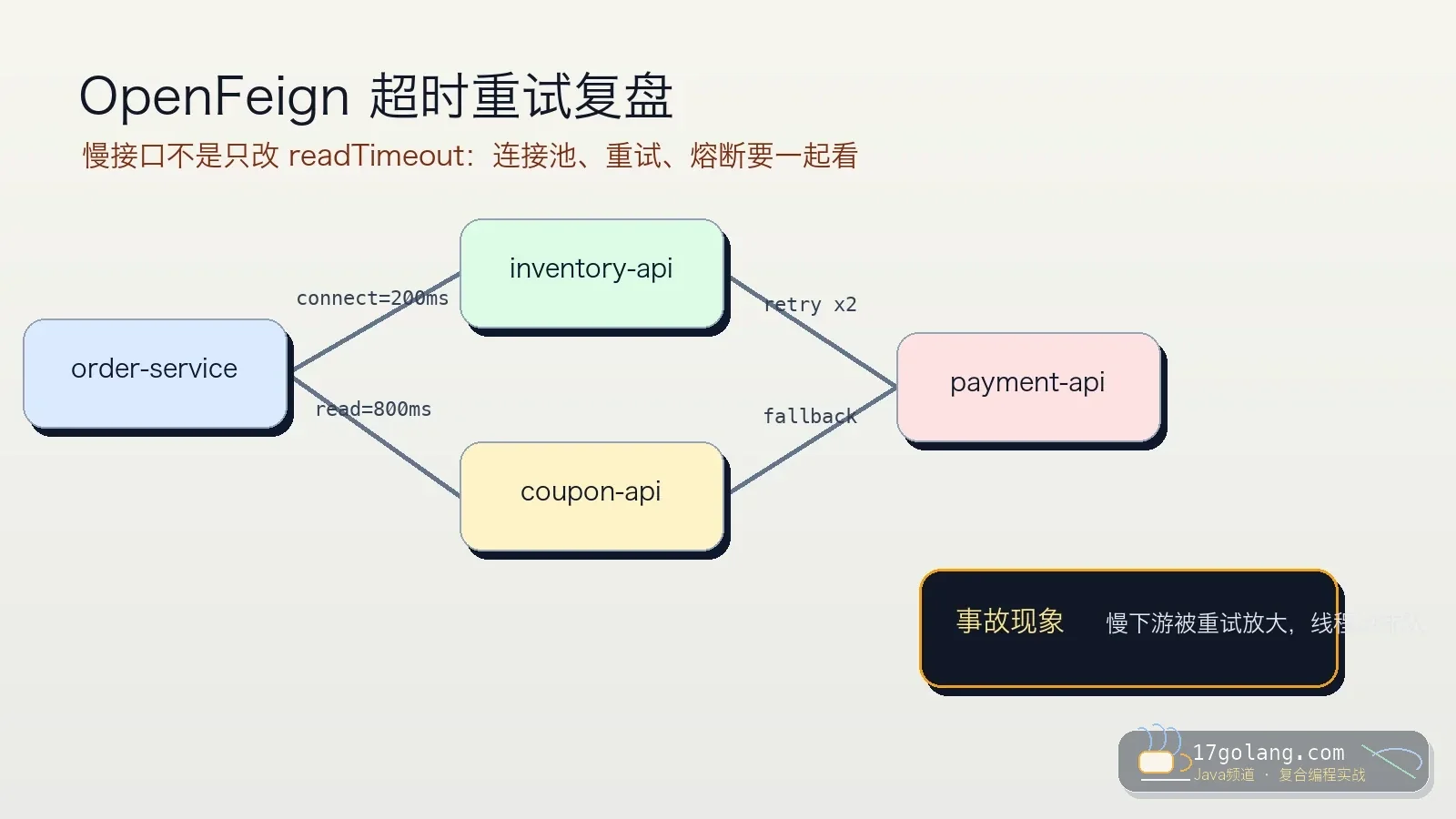

- 文章 · java教程 | 4天前 | 微服务 · 生产实践 · Java教程 · Spring Cloud · OpenFeign · java 微服务 Spring Cloud 超时重试 OpenFeign

- OpenFeign 超时重试踩坑:别把慢下游重试成全链路雪崩

- 363浏览 收藏

-

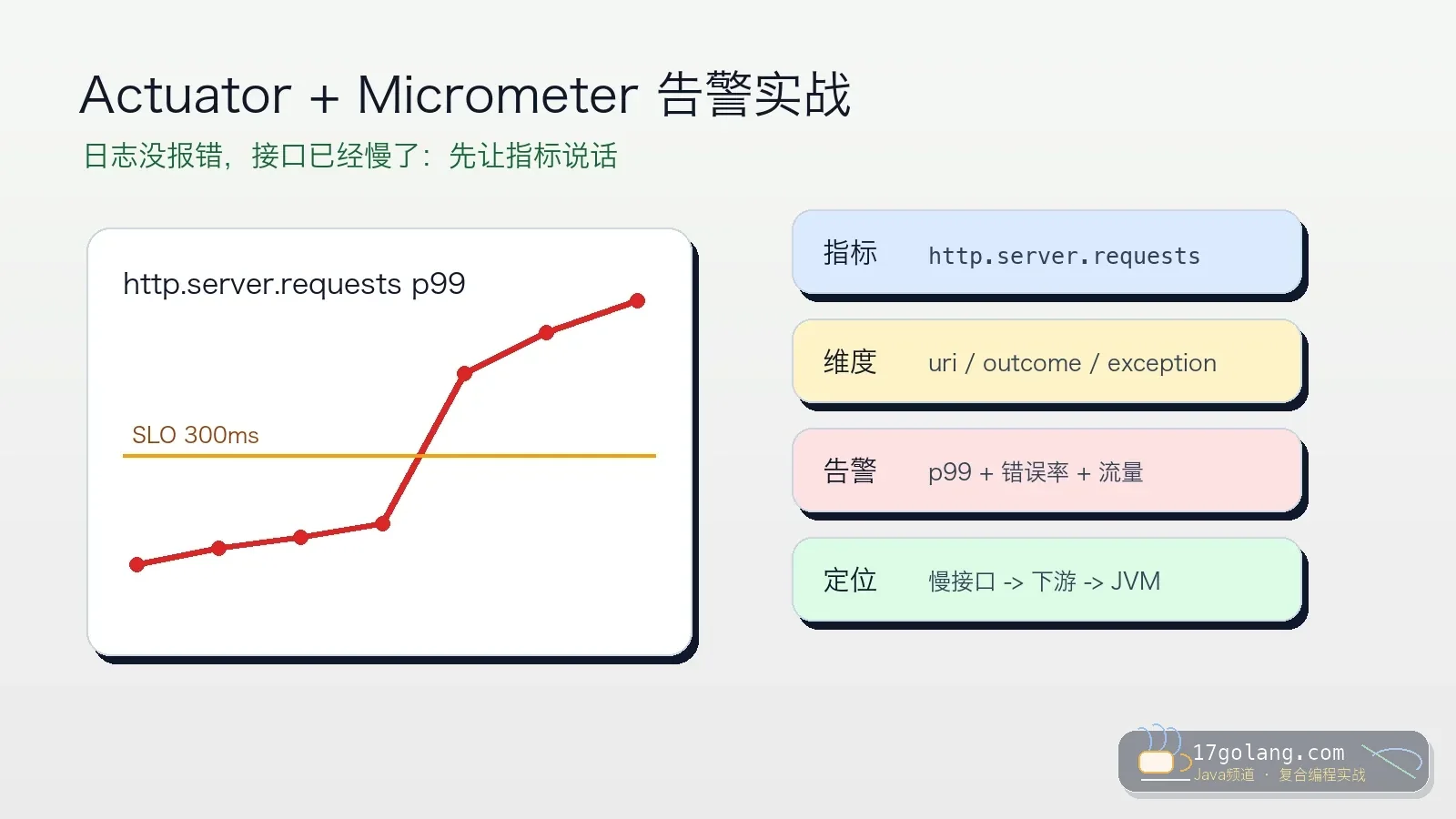

- 文章 · java教程 | 4天前 | Spring Boot · 生产实践 · Java教程 · Micrometer · Actuator · java spring boot Micrometer 可观测性 actuator

- Spring Boot 指标告警实战:Actuator + Micrometer 让慢接口先暴露

- 240浏览 收藏

-

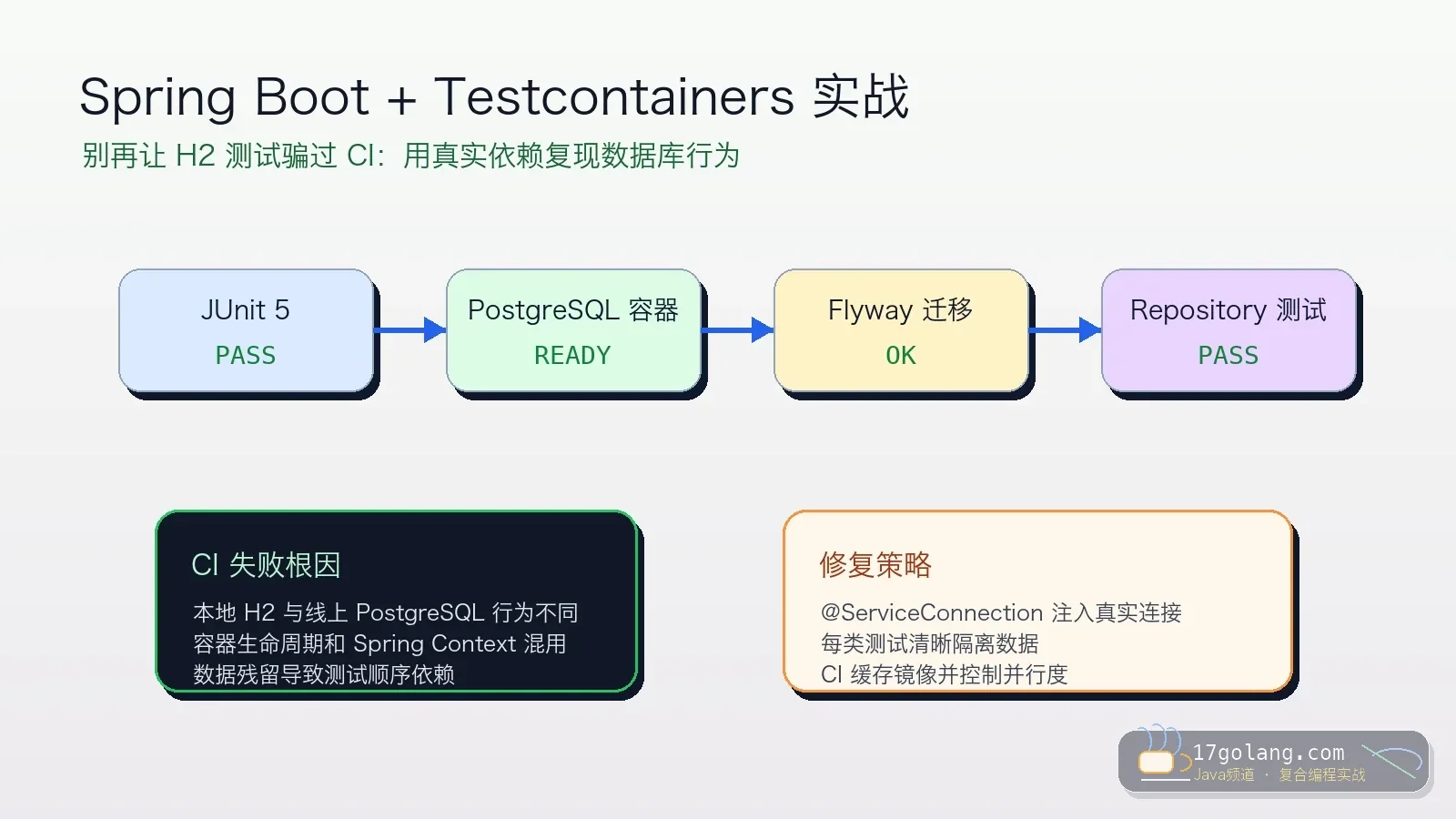

- 文章 · java教程 | 4天前 | 工程化 · Spring Boot · junit · Java教程 · Testcontainers · java 集成测试 spring boot JUnit 5 Testcontainers

- Spring Boot 集成测试别再只靠 H2:Testcontainers 落地踩坑复盘

- 154浏览 收藏

-

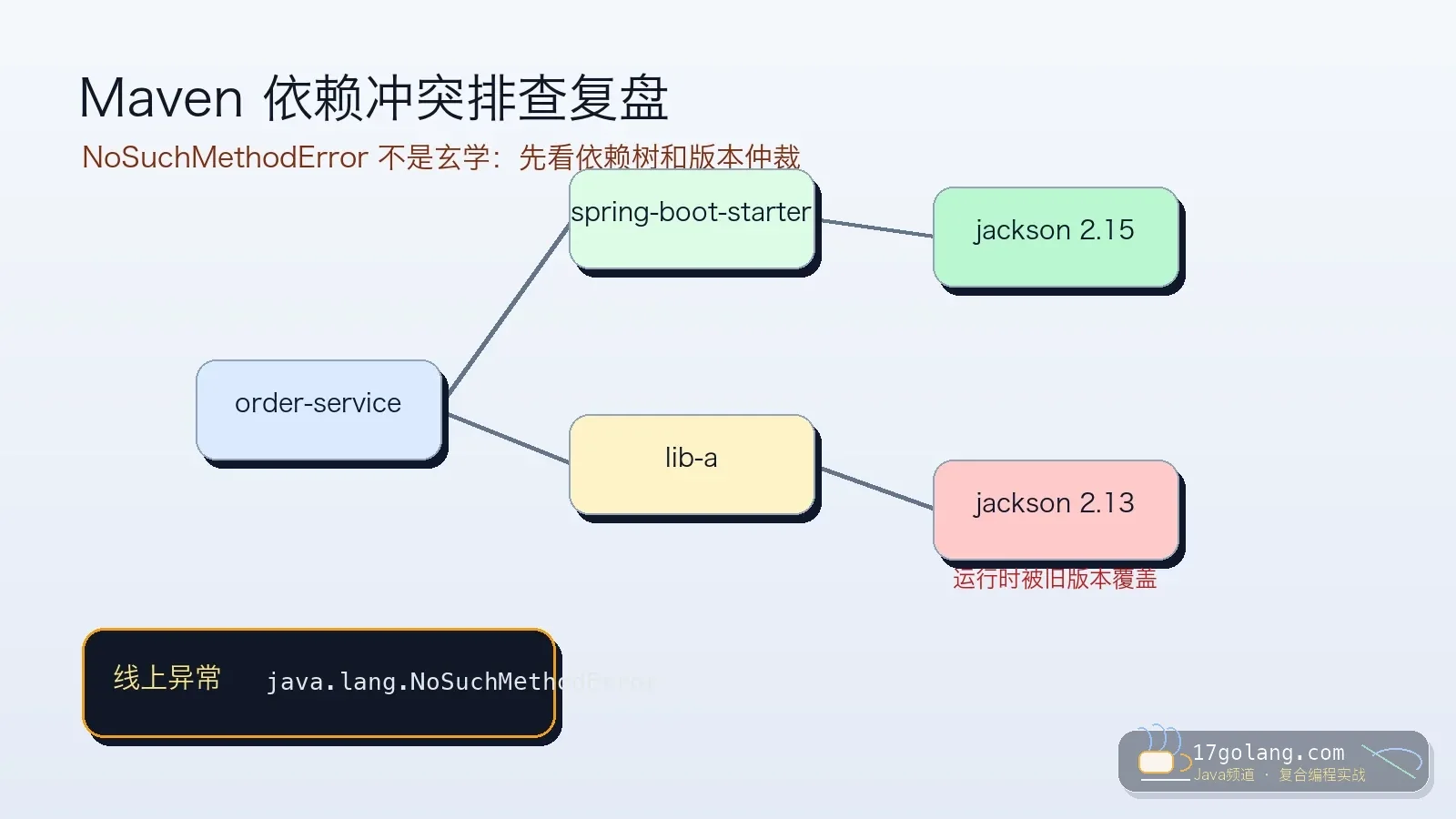

- 文章 · java教程 | 4天前 | 依赖管理 · Spring Boot · maven · 生产实践 · Java教程 · java maven spring boot 依赖冲突 工程化

- Maven 依赖冲突排查:NoSuchMethodError 不是玄学,先看依赖树

- 135浏览 收藏

查看更多

课程推荐

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

查看更多

AI推荐

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 6923次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 7335次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 7147次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 9079次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 7806次使用

查看更多

相关文章

-

- 提升Java功能开发效率的有力工具:微服务架构

- 2023-10-06 501浏览

-

- 掌握Java海康SDK二次开发的必备技巧

- 2023-10-01 501浏览

-

- 如何使用java实现桶排序算法

- 2023-10-03 501浏览

-

- Java开发实战经验:如何优化开发逻辑

- 2023-10-31 501浏览

-

- 如何使用Java中的Math.max()方法比较两个数的大小?

- 2023-11-18 501浏览