机器学习超参数调优总结(PySpark ML)

哈喽!今天心血来潮给大家带来了《机器学习超参数调优总结(PySpark ML)》,想必大家应该对科技周边都不陌生吧,那么阅读本文就都不会很困难,以下内容主要涉及到,若是你正在学习科技周边,千万别错过这篇文章~希望能帮助到你!

ML中的一个重要任务是模型选择,或者使用数据为给定任务找到最佳的模型或参数。这也称为调优。可以对单个的估计器(如LogisticRegression)进行调优,也可以对包括多种算法、特性化和其他步骤的整个pipeline进行调优。用户可以一次调优整个Pipeline,而不是分别调优 Pipeline 中的每个元素。

ML中的一个重要任务是模型选择,或者使用数据为给定任务找到最佳的模型或参数。这也称为调优。可以对单个的Estimator(如LogisticRegression)进行调优,也可以对包括多种算法、特性化和其他步骤的整个pipeline进行调优。用户可以一次调优整个Pipeline,而不是分别调优Pipeline中的每个元素。

MLlib支持使用CrossValidator和TrainValidationSplit等工具进行模型选择。这些工具需要具备以下条件:

- 估计器:要调优的算法或管道pipeline

- 一组参数:可选择的参数,有时称为搜索的“参数网格”

- 评估者:度量拟合模型在测试数据上的表现

这些模型选择工具的工作方式如下:

- 他们将输入数据拆分为单独的训练和测试数据集。

- 对于每个(训练、测试)对,它们遍历ParamMap 集合:

对于每个ParamMap,使用这些参数拟合Estimator,得到拟合的Model,并使用Evaluator 评估Model的性能。

- 他们选择Model由表现最好的一组参数产生。

为了帮助构造参数网格,用户可以使用ParamGridBuilder。默认情况下,参数网格中的参数集以串行方式计算。在使用CrossValidator或TrainValidationSplit运行模型选择之前,可以通过将并行度设置为2或更多(1的值将是串行的)来并行地进行参数评估。并行度的值应该谨慎选择,以便在不超过集群资源的情况下最大化并行度,较大的值不一定会提高性能。一般来说,10以上的值对大多数集群来说应该足够了。

交叉验证

CrossValidator交叉验证器首先将数据集分割为一组折叠数据集,这些折叠数据集用作单独的训练数据集和测试数据集。例如,当k=3次时,CrossValidator将生成3对(训练,测试)数据集,每对数据集使用2/3的数据进行训练,1/3的数据进行测试。为了评估一个特定的ParamMap, CrossValidator通过在3个不同的(训练,测试)数据集对上拟合Estimator产生的3个模型计算平均评估度量。

在确定最佳ParamMap之后,CrossValidator最终使用最佳ParamMap和整个数据集重新匹配Estimator。

from pyspark.ml import Pipeline

from pyspark.ml.classification import LogisticRegression

from pyspark.ml.evaluation import BinaryClassificationEvaluator

from pyspark.ml.feature import HashingTF, Tokenizer

from pyspark.ml.tuning import CrossValidator, ParamGridBuilder

# 准备训练文件,并做好标签。

training = spark.createDataFrame([

(0, "a b c d e spark", 1.0),

(1, "b d", 0.0),

(2, "spark f g h", 1.0),

(3, "hadoop mapreduce", 0.0),

(4, "b spark who", 1.0),

(5, "g d a y", 0.0),

(6, "spark fly", 1.0),

(7, "was mapreduce", 0.0),

(8, "e spark program", 1.0),

(9, "a e c l", 0.0),

(10, "spark compile", 1.0),

(11, "hadoop software", 0.0)

], ["id", "text", "label"])

# 配置一个ML管道,它由树stages组成:tokenizer、hashingTF和lr。

tokenizer = Tokenizer(inputCol="text", outputCol="words")

hashingTF = HashingTF(inputCol=tokenizer.getOutputCol(), outputCol="features")

lr = LogisticRegression(maxIter=10)

pipeline = Pipeline(stages=[tokenizer, hashingTF, lr])

# 我们现在将Pipeline作为一个Estimator,将其包装在CrossValidator实例中。

# 这将允许我们共同选择所有管道阶段的参数。

# 交叉验证器需要一个Estimator、一组Estimator ParamMaps和一个Evaluator。

# 我们使用ParamGridBuilder来构造一个用于搜索的参数网格。

# hashingTF.numFeatures 的3个值, lr.regParam的2个值,

# 这个网格将有3 x 2 = 6的参数设置供CrossValidator选择。

paramGrid = ParamGridBuilder()

.addGrid(hashingTF.numFeatures, [10, 100, 1000])

.addGrid(lr.regParam, [0.1, 0.01])

.build()

crossval = CrossValidator(estimator=pipeline,

estimatorParamMaps=paramGrid,

evaluator=BinaryClassificationEvaluator(),

numFolds=2)# 使用3+ folds

# 运行交叉验证,并选择最佳参数集。

cvModel = crossval.fit(training)

# 准备测试未标注的文件

test = spark.createDataFrame([

(4, "spark i j k"),

(5, "l m n"),

(6, "mapreduce spark"),

(7, "apache hadoop")

], ["id", "text"])

# 对测试文档进行预测, cvModel使用发现的最佳模型(lrModel)。

prediction = cvModel.transform(test)

selected = prediction.select("id", "text", "probability", "prediction")

for row in selected.collect():

print(row)训练验证拆分

除了 CrossValidator 之外,Spark 还提供了用于超参数调优的 TrainValidationSplit。TrainValidationSplit 只计算每个参数组合一次,而在 CrossValidator 的情况下是k次。因此,它的成本较低,但当训练数据集不够大时,它不会产生可靠的结果。

与 CrossValidator 不同,TrainValidationSplit 创建单个(训练、测试)数据集对。它使用 trainRatio 参数将数据集分成这两部分。例如,当trainRatio=0.75 时,TrainValidationSplit 将生成一个训练和测试数据集对,其中 75% 的数据用于训练,25% 用于验证。

像 CrossValidator 一样,TrainValidationSplit 最终使用最佳 ParamMap 和整个数据集匹配 Estimator。

from pyspark.ml.evaluation import RegressionEvaluator

from pyspark.ml.regression import LinearRegression

from pyspark.ml.tuning import ParamGridBuilder, TrainValidationSplit

# Prepare training and test data.

data = spark.read.format("libsvm")

.load("data/mllib/sample_linear_regression_data.txt")

train, test = data.randomSplit([0.9, 0.1], seed=12345)

lr = LinearRegression(maxIter=10)

# 我们使用ParamGridBuilder来构造一个用于搜索的参数网格。

# TrainValidationSplit将尝试所有值的组合,并使用评估器确定最佳模型。

paramGrid = ParamGridBuilder()

.addGrid(lr.regParam, [0.1, 0.01])

.addGrid(lr.fitIntercept, [False, True])

.addGrid(lr.elasticNetParam, [0.0, 0.5, 1.0])

.build()

# 在这种情况下,估计器是简单的线性回归。

# TrainValidationSplit需要一个Estimator、一组Estimator ParamMaps 和一个 Evaluator。

tvs = TrainValidationSplit(estimator=lr,

estimatorParamMaps=paramGrid,

evaluator=RegressionEvaluator(),

# 80%的数据将用于培训,20%用于验证。

trainRatio=0.8)

# 运行TrainValidationSplit,并选择最佳参数集。

model = tvs.fit(train)

# 对测试数据进行预测。模型是参数组合后性能最好的模型。

model.transform(test)

.select("features", "label", "prediction")

.show() 好了,本文到此结束,带大家了解了《机器学习超参数调优总结(PySpark ML)》,希望本文对你有所帮助!关注golang学习网公众号,给大家分享更多科技周边知识!

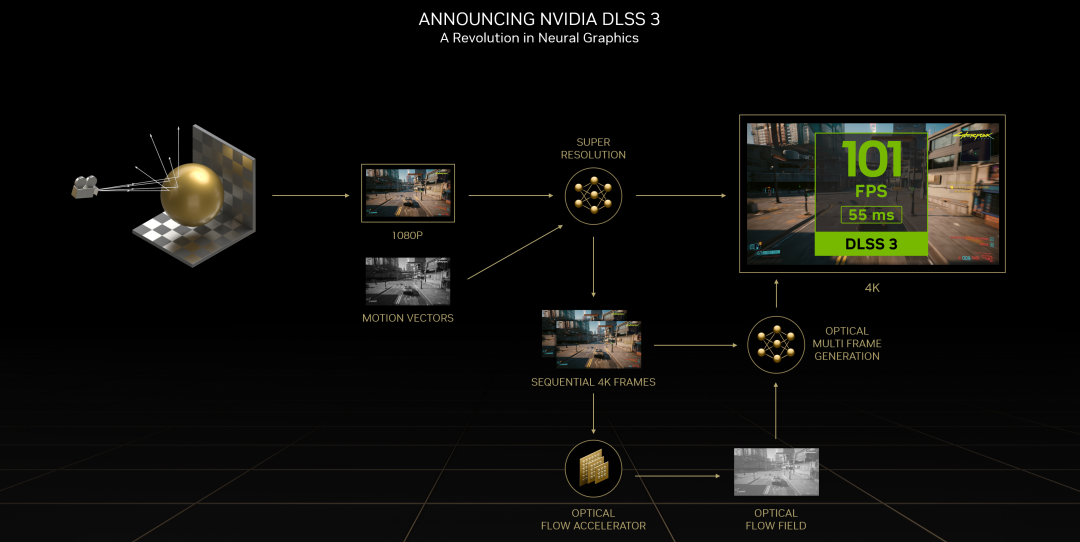

神经渲染与AI生成框架结合,五倍提升游戏速度,英伟达是这样做的

神经渲染与AI生成框架结合,五倍提升游戏速度,英伟达是这样做的

- 上一篇

- 神经渲染与AI生成框架结合,五倍提升游戏速度,英伟达是这样做的

- 下一篇

- 清华作者排名第一,多人中稿超十篇:NeurIPS 2022统计数据出炉

-

- 科技周边 · 人工智能 | 3小时前 |

- AI提示词怎么写避免模板化_去AI味的提示词设计方法是什么

- 215浏览 收藏

-

- 科技周边 · 人工智能 | 3小时前 |

- WorkBuddy 绿色版与安装版有什么区别?

- 296浏览 收藏

-

- 科技周边 · 人工智能 | 3小时前 |

- 龙虾机器人聊天记录如何导出与备份?

- 334浏览 收藏

-

- 科技周边 · 人工智能 | 4小时前 |

- DeepSeek API身份验证(Authentication)失败怎么办?

- 233浏览 收藏

-

- 科技周边 · 人工智能 | 4小时前 |

- 龙虾openclaw对接支付宝AI付开发文档 接口调用示例【深度】

- 295浏览 收藏

-

- 科技周边 · 人工智能 | 4小时前 |

- WorkBuddy 安装失败?可能是由于系统版本过低

- 118浏览 收藏

-

- 科技周边 · 人工智能 | 4小时前 |

- DeepSeek V4逻辑推理变弱_模型版本回退与提示词优化【降智】

- 363浏览 收藏

-

- 科技周边 · 人工智能 | 4小时前 |

- WorkBuddy欠费停服如何快速恢复_补缴欠款与资源自动释放风险

- 162浏览 收藏

-

- 科技周边 · 人工智能 | 4小时前 |

- ChatGPT如何生成测试数据 ChatGPT仿真数据创建指南

- 455浏览 收藏

-

- 科技周边 · 人工智能 | 5小时前 | CodeGeeX CodeGeeX如何生成Python代码完整教程

- CodeGeeX怎么写Python异常处理代码_CodeGeeX辅助构建健壮程序逻辑【异常处理】

- 133浏览 收藏

-

- 科技周边 · 人工智能 | 5小时前 |

- 可灵AI恐怖悬疑风格_惊悚氛围画面的光影与音效设置

- 101浏览 收藏

-

- 科技周边 · 人工智能 | 5小时前 | 哩布哩布AI

- 哩布哩布AI怎么使用角色扮演聊天_哩布哩布AI智能对话功能实战

- 128浏览 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 4455次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 4805次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 4684次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 6477次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 5057次使用

-

- GPT-4王者加冕!读图做题性能炸天,凭自己就能考上斯坦福

- 2023-04-25 501浏览

-

- 单块V100训练模型提速72倍!尤洋团队新成果获AAAI 2023杰出论文奖

- 2023-04-24 501浏览

-

- ChatGPT 真的会接管世界吗?

- 2023-04-13 501浏览

-

- VR的终极形态是「假眼」?Neuralink前联合创始人掏出新产品:科学之眼!

- 2023-04-30 501浏览

-

- 实现实时制造可视性优势有哪些?

- 2023-04-15 501浏览