全面了解大语言模型,这有一份阅读清单

偷偷努力,悄无声息地变强,然后惊艳所有人!哈哈,小伙伴们又来学习啦~今天我将给大家介绍《全面了解大语言模型,这有一份阅读清单》,这篇文章主要会讲到等等知识点,不知道大家对其都有多少了解,下面我们就一起来看一吧!当然,非常希望大家能多多评论,给出合理的建议,我们一起学习,一起进步!

大型语言模型已经引起了公众的注意,短短五年内,Transforme等模型几乎完全改变了自然语言处理领域。此外,它们还开始在计算机视觉和计算生物学等领域引发革命。

鉴于Transformers对每个人的研究进程都有如此大的影响,本文将为大家介绍一个简短的阅读清单,供机器学习研究人员和从业者入门使用。

下面的列表主要是按时间顺序展开的,主要是一些学术研究论文。当然,还有许多其他有用的资源。例如:

- Jay Alammar撰写的《The Illustrated Transformer》

- Lilian Weng撰写的《The Transformer Family》

- Xavier Amatriain撰写的《Transformer models: an introduction and catalog — 2023 Edition》

- Andrej Karpathy写的nanoGPT库

对主要架构和任务的理解

如果你是Transformers、大型语言模型新手,那么这几篇文章最适合你。

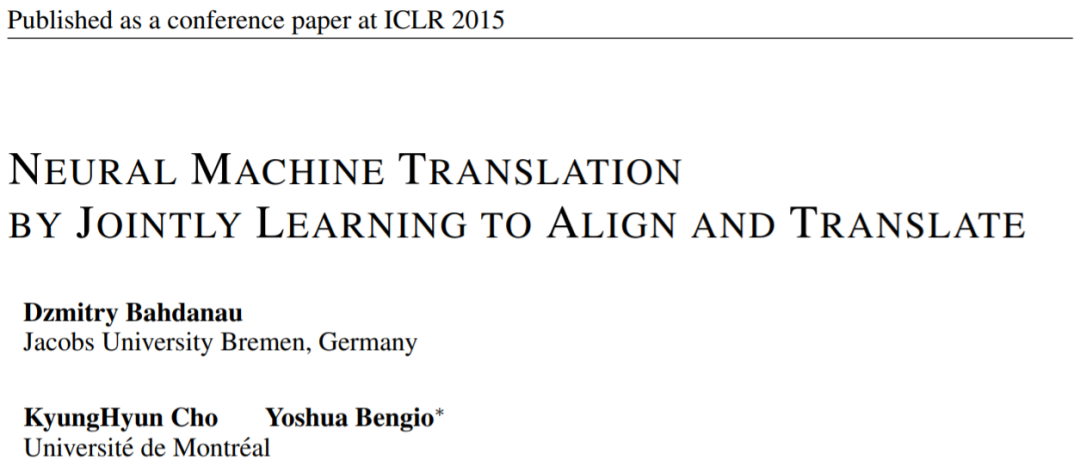

论文1:《Neural Machine Translation by Jointly Learning to Align and Translate》

论文地址:https://arxiv.org/pdf/1409.0473.pdf

本文引入了一种循环神经网络(RNN)注意力机制,提高了模型远程序列建模能力。这使得RNN能够更准确地翻译较长的句子——这也是后来开发原始Transformer架构的动机。

图源: https://arxiv.org/abs/1409.0473

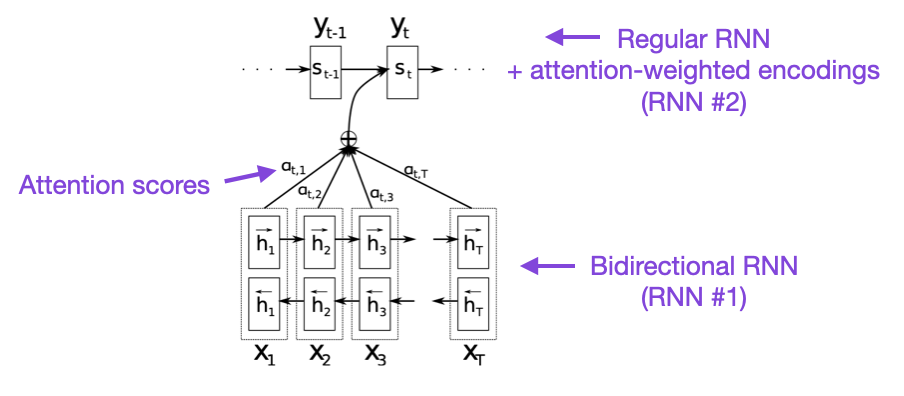

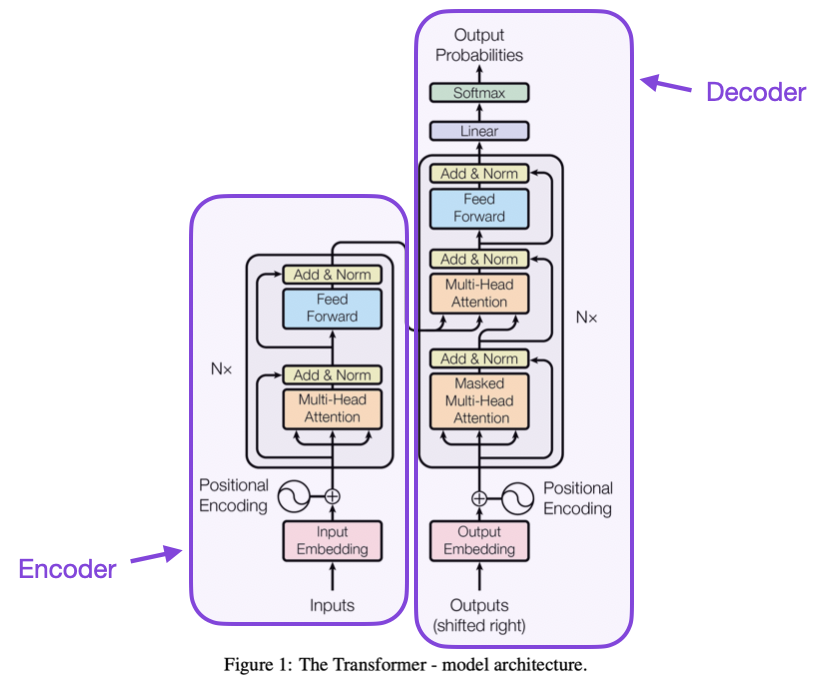

论文2:《Attention Is All You Need》

论文地址:https://arxiv.org/abs/1706.03762

本文介绍了由编码器和解码器组成的原始Transformer架构,这些部分将在以后作为单独模块进行相关介绍。此外,本文还介绍了缩放点积注意力机制、多头注意力块和位置输入编码等概念,这些概念仍然是现代Transformer的基础。

图源:https://arxiv.org/abs/1706.03762

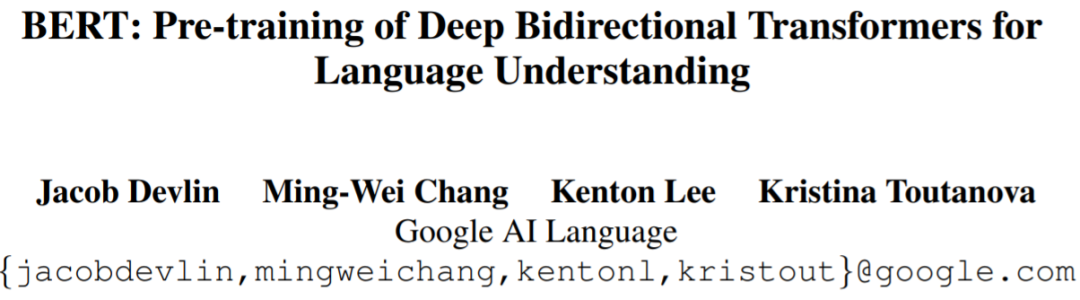

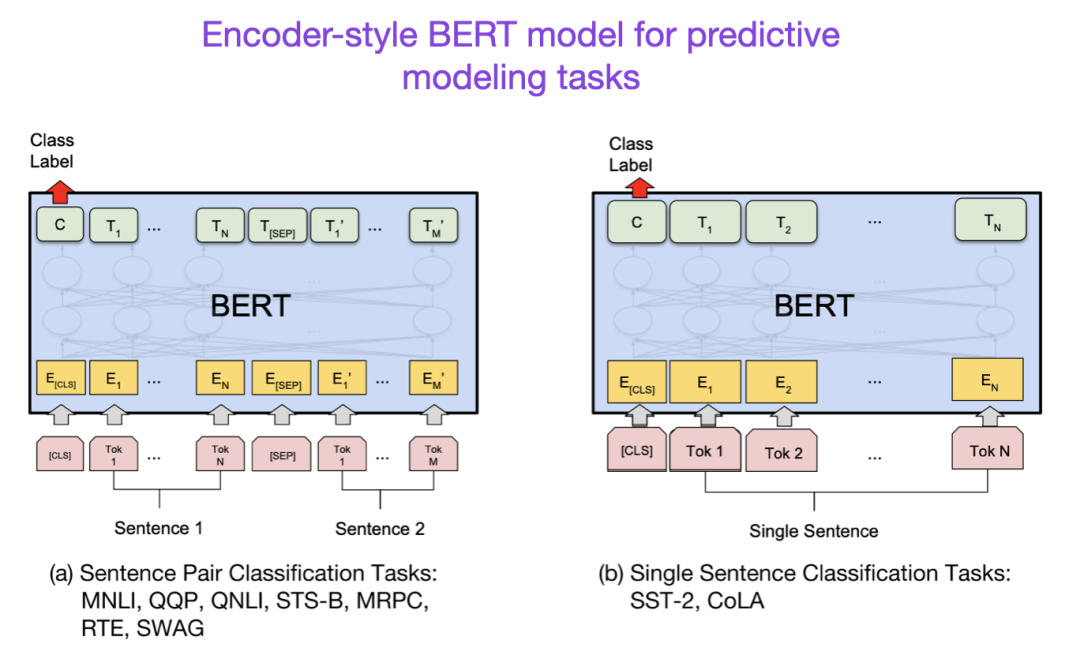

论文3:《BERT: Pre-training of Deep Bidirectional Transformers for Language Understanding》

论文地址:https://arxiv.org/abs/1810.04805

大型语言模型研究遵循最初的Transformer架构,然后开始向两个方向延伸:用于预测建模任务(如文本分类)的Transformer和用于生成建模任务(如翻译、摘要和其他形式的文本创建)的Transformer 。

BERT论文介绍了掩码语言建模原始概念,如果你对这个研究分支感兴趣,那么可以跟进RoBERTa,其简化了预训练目标。

图源:https://arxiv.org/abs/1810.04805

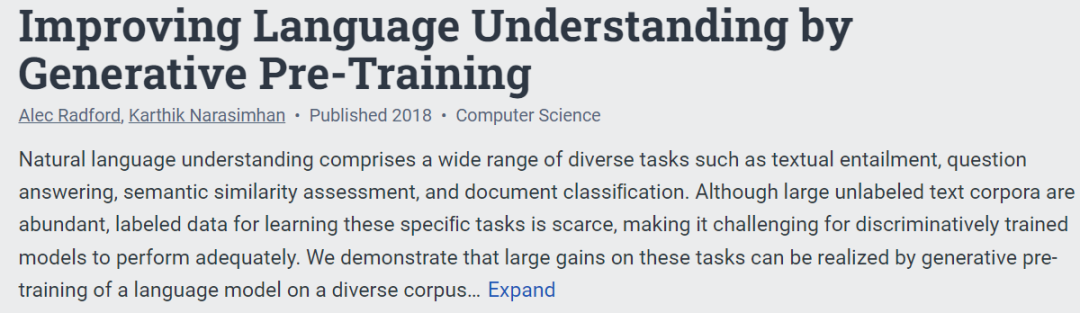

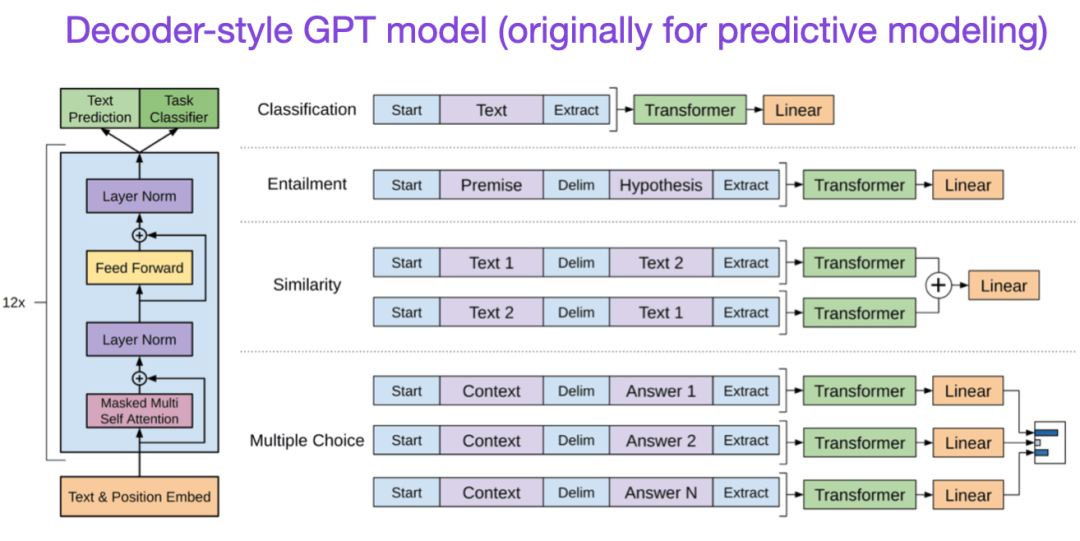

论文4:《Improving Language Understanding by Generative Pre-Training》

论文地址:https://www.semanticscholar.org/paper/Improving-Language-Understanding-by-Generative-Radford-Narasimhan/cd18800a0fe0b668a1cc19f2ec95b5003d0a5035

最初的GPT论文介绍了流行的解码器风格的架构和通过下一个单词预测进行预训练。BERT由于其掩码语言模型预训练目标,可以被认为是一个双向Transformer,而GPT是一个单向自回归模型。虽然GPT嵌入也可以用于分类,但GPT方法是当今最有影响力的LLMs(如ChatGPT)的核心。

如果你对这个研究分支感兴趣,那么可以跟进GPT-2和GPT-3的论文。此外,本文将在后面单独介绍InstructGPT方法。

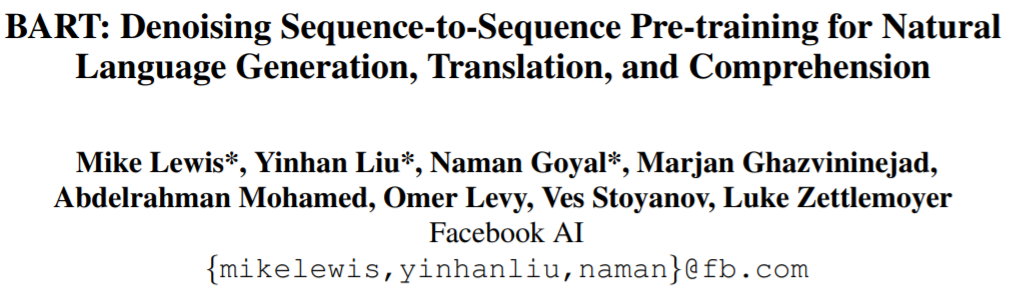

论文5:《BART: Denoising Sequence-to-Sequence Pre-training for Natural Language Generation, Translation, and Comprehension》

论文地址 https://arxiv.org/abs/1910.13461.

如上所述, BERT型编码器风格的LLM通常是预测建模任务的首选,而GPT型解码器风格的LLM更擅长生成文本。为了两全其美,上面的BART论文结合了编码器和解码器部分。

扩展定律与效率提升

如果你想了解更多关于提高Transformer效率的技术,可以参考以下论文

- 论文1:《A Survey on Efficient Training of Transformers》

- 论文地址:https://arxiv.org/abs/2302.01107

- 论文2:《FlashAttention: Fast and Memory-Efficient Exact Attention with IO-Awareness》

- 论文地址:https://arxiv.org/abs/2205.14135

- 论文3:《Cramming: Training a Language Model on a Single GPU in One Day》

- 论文地址:https://arxiv.org/abs/2212.14034

- 论文4:《Training Compute-Optimal Large Language Models》

- 论文地址:https://arxiv.org/abs/2203.15556

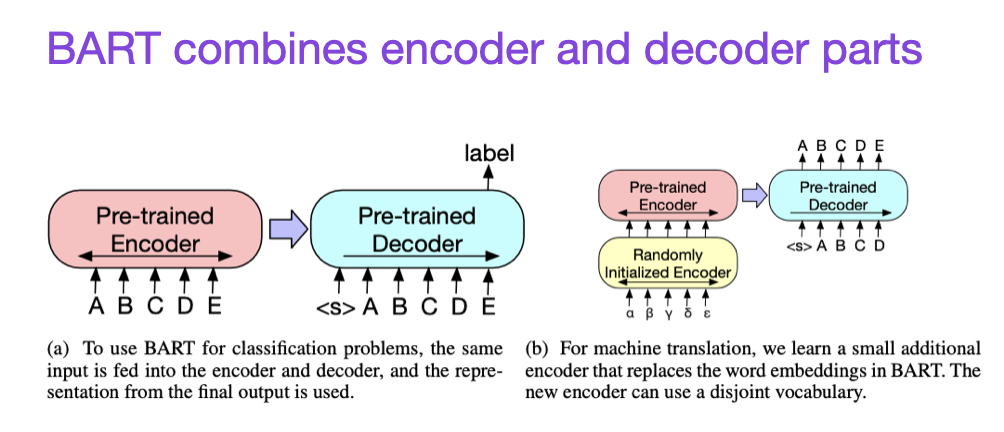

此外,还有论文《Training Compute-Optimal Large Language Models》

论文地址:https://arxiv.org/abs/2203.15556

本文介绍了700亿参数的Chinchilla模型,该模型在生成建模任务上优于流行的1750亿参数的GPT-3模型。然而,它的主要点睛之处在于,当代大型语言模型训练严重不足。

本文定义了用于大型语言模型训练的线性scaling law。例如,虽然Chinchilla的大小只有GPT-3的一半,但它的表现优于GPT-3,因为它是在1.4万亿(而不是3000亿)token上进行训练的。换句话说,训练token的数量和模型大小一样重要。

对齐——将大型语言模型朝着预期的目标和兴趣引导

近年来出现了许多相对强大的大型语言模型,它们可以生成真实的文本(例如GPT-3和Chinchilla)。就常用的预训练范式而言,目前似乎已经达到了一个上限。

为了使语言模型更能帮助到人类,减少错误信息和不良语言,研究人员设计了额外的训练范式来微调预训练的基础模型,包括如下论文。

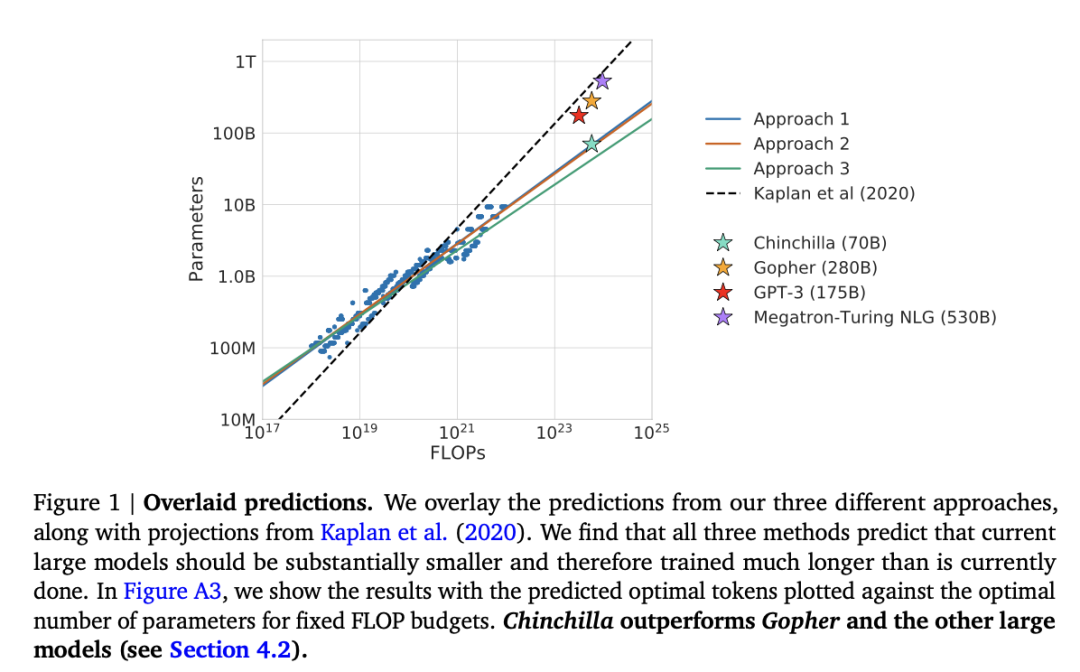

- 论文1:《Training Language Models to Follow Instructions with Human Feedback》

- 论文地址:https://arxiv.org/abs/2203.02155

在这篇所谓的InstructGPT论文中,研究人员使用了RLHF(Reinforcement Learning from Human Feedback)。他们从预训练的GPT-3基础模型开始,并使用监督学习对人类生成的提示响应对进行进一步微调(步骤1)。接下来,他们要求人类对模型输出进行排序以训练奖励模型(步骤2)。最后,他们使用奖励模型通过近端策略优化(步骤3)使用强化学习来更新预训练和微调的GPT-3模型。

顺便说一句,这篇论文也被称为描述ChatGPT背后思想的论文——根据最近的传言,ChatGPT是InstructGPT的扩展版本,它在更大的数据集上进行了微调。

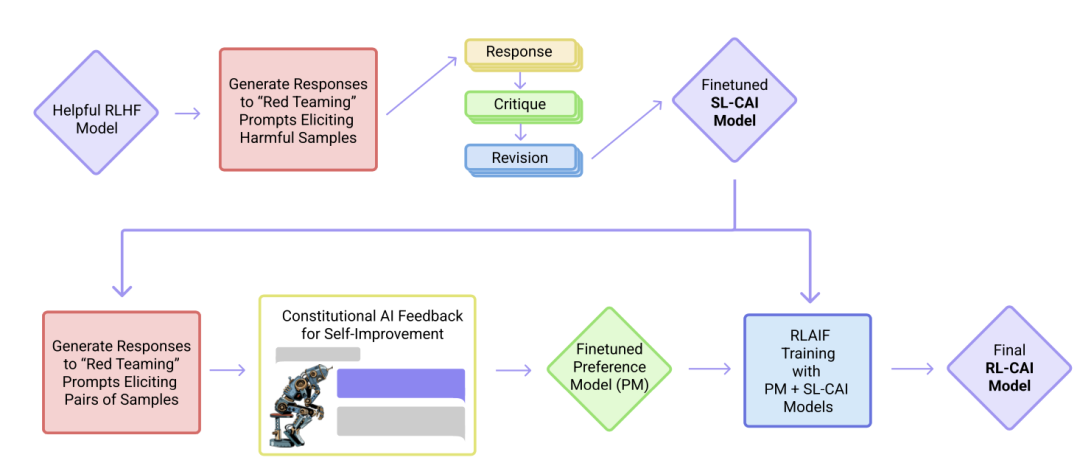

- 论文2:《Constitutional AI: Harmlessness from AI Feedback》

- 论文地址:https://arxiv.org/abs/2212.08073

在这篇论文中,研究人员进一步推进了对齐的想法,提出了一种创建「harmless」的AI系统的训练机制。研究人员提出了一种基于规则列表(由人类提供)的自训练机制,而不是直接由人类监督。与上面提到的InstructGPT论文类似,所提出的方法使用了强化学习方法。

总结

本文对上方表单的排列尽量保持简洁美观,建议重点关注前10篇论文,以了解当代大型语言模型背后的设计、局限和演变。

如果想深入阅读,建议参考上述论文中的参考文献。或者,这里有一些额外的资源,供读者进一步研究:

GPT的开源替代方案

- 论文1:《BLOOM: A 176B-Parameter Open-Access Multilingual Language Model》

- 论文地址:https://arxiv.org/abs/2211.05100

- 论文2:《OPT: Open Pre-trained Transformer Language Models》

- 论文地址:https://arxiv.org/abs/2205.01068

ChatGPT的替代方案

- 论文1《LaMDA: Language Models for Dialog Applications》

- 论文地址:https://arxiv.org/abs/2201.08239

- 论文2:《Improving alignment of dialogue agents via targeted human judgements》

- 论文地址:https://arxiv.org/abs/2209.14375

- 论文3:《BlenderBot 3: a deployed conversational agent that continually learns to responsibly engage》

- 论文地址:https://arxiv.org/abs/2208.03188

计算生物学中的大型语言模型

- 论文1:《 ProtTrans: Towards Cracking the Language of Life’s Code Through Self-Supervised Learning 》

- 论文地址:https://arxiv.org/abs/2007.06225

- 论文2:《Highly accurate protein structure prediction with AlphaFold》

- 论文地址:https://www.nature.com/articles/s41586-021-03819-2

- 论文3:《Large Language Models Generate Functional Protein Sequences Across Diverse Families》

- 论文地址:https://www.nature.com/articles/s41587-022-01618-2

今天带大家了解了的相关知识,希望对你有所帮助;关于科技周边的技术知识我们会一点点深入介绍,欢迎大家关注golang学习网公众号,一起学习编程~

对标ChatGPT,谷歌CEO:使用Bard肯定会出错,欢迎用户反馈

对标ChatGPT,谷歌CEO:使用Bard肯定会出错,欢迎用户反馈

- 上一篇

- 对标ChatGPT,谷歌CEO:使用Bard肯定会出错,欢迎用户反馈

- 下一篇

- 我们一起聊聊ChatGPT,它真的很难牛!

-

- 科技周边 · 人工智能 | 3分钟前 |

- 千问怎么设置快捷指令_千问指令创建与一键调用【技巧】

- 389浏览 收藏

-

- 科技周边 · 人工智能 | 21分钟前 |

- AnythingLLM怎么搭建知识库_AnythingLLM私有知识库教程

- 435浏览 收藏

-

- 科技周边 · 人工智能 | 22分钟前 |

- WorkBuddy模型回复包含乱码字符怎么处理_过滤非UTF8非法字符

- 268浏览 收藏

-

- 科技周边 · 人工智能 | 23分钟前 |

- Claude 自动修复代码 Bug 的成功率测试

- 261浏览 收藏

-

- 科技周边 · 人工智能 | 24分钟前 |

- 扣子AI如何集成第三方API_扣子AI API接入与调用方法【攻略】

- 318浏览 收藏

-

- 科技周边 · 人工智能 | 30分钟前 |

- 什么是Claude Mythos的Tool Use Claude Mythos工具使用详解

- 378浏览 收藏

-

- 科技周边 · 人工智能 | 33分钟前 |

- AI助手怎么用来写周报_AI助手写工作总结方法是什么

- 306浏览 收藏

-

- 科技周边 · 人工智能 | 44分钟前 | Hermes Agent HermesAgent

- 精准提交任务_减少 Hermes Agent 无效 Token 消耗的黄金法则

- 393浏览 收藏

-

- 科技周边 · 人工智能 | 50分钟前 | 夸克AI 夸克AI大模型

- 夸克AI怎么写岗位说明书_夸克AI组织架构梳理指南【组织发展】

- 190浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 | openclaw

- OpenClaw自然语言交互:像聊天一样指挥电脑干活

- 147浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 |

- Inkscape导入PS路径乱了咋办_Inkscape规整路径导入法【修复】

- 305浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 |

- 怎么利用Perplexity快速对比不同云厂商的算力价格_检索AWS与Azure报价

- 217浏览 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 4441次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 4798次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 4677次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 6462次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 5048次使用

-

- GPT-4王者加冕!读图做题性能炸天,凭自己就能考上斯坦福

- 2023-04-25 501浏览

-

- 单块V100训练模型提速72倍!尤洋团队新成果获AAAI 2023杰出论文奖

- 2023-04-24 501浏览

-

- ChatGPT 真的会接管世界吗?

- 2023-04-13 501浏览

-

- VR的终极形态是「假眼」?Neuralink前联合创始人掏出新产品:科学之眼!

- 2023-04-30 501浏览

-

- 实现实时制造可视性优势有哪些?

- 2023-04-15 501浏览