Python爬虫入门:Scrapy框架使用教程

学习知识要善于思考,思考,再思考!今天golang学习网小编就给大家带来《Python爬虫入门:Scrapy框架详解》,以下内容主要包含等知识点,如果你正在学习或准备学习文章,就都不要错过本文啦~让我们一起来看看吧,能帮助到你就更好了!

Scrapy是Python爬虫开发的利器,因其功能完备、高效稳定且模块化设计而广受欢迎。它封装了异步请求处理、数据提取工具(如CSS选择器和XPath)、以及强大的中间件机制(包括下载器和Spider中间件),极大简化了并发控制、异常处理与反爬应对。其结构化项目布局提升开发效率,通过定义Item明确数据结构,并借助Pipeline实现数据清洗、验证、存储等后处理流程,使爬虫项目更清晰、可维护性强,适合大规模或长期运行的任务。

用Python制作爬虫,特别是当任务量稍微大一点、需要更稳定和高效的解决方案时,Scrapy框架绝对是绕不开的一个选择。它不是一个简单的库,而是一个功能完备、高度可扩展的爬虫框架,能帮你把抓取、解析、存储等一系列复杂流程管理得井井有条。

Scrapy框架提供了一套完整的解决方案,让你能够高效地构建和运行爬虫项目。它将爬虫的各个环节模块化,包括请求调度、下载、解析、数据处理等,大大提升了开发效率和爬虫的稳定性。

Scrapy为什么是爬虫开发的“利器”?

我个人觉得,Scrapy最迷人的地方在于它把爬虫开发中那些最让人头疼的细节都封装好了。比如,异步请求处理,这意味着你的爬虫在等待一个网页响应的时候,可以同时去请求其他网页,效率自然就上去了。它内置了强大的CSS选择器和XPath,让数据提取变得异常方便,你不用再为如何精准定位页面元素而绞尽脑汁。

更重要的是,Scrapy有一套成熟的中间件(Middleware)机制。下载器中间件(Downloader Middleware)可以让你轻松地处理User-Agent、代理IP、Cookie甚至进行请求重试等操作,这对于应对反爬机制非常关键。而Spider中间件(Spider Middleware)则能在请求被Spider处理之前或之后进行一些逻辑处理。想象一下,你不需要自己去写复杂的并发控制、异常处理,Scrapy都帮你搞定了,你只需要专注于数据本身。这种“傻瓜式”的强大,真是让人欲罢不能。对于需要长期维护或规模化运行的爬虫项目来说,Scrapy的结构化和可扩展性,简直是救命稻草。

Scrapy项目搭建与第一个爬虫实战

要开始一个Scrapy项目,首先得安装它:pip install scrapy。

然后,我们可以创建一个新的Scrapy项目。这就像是给你的爬虫项目搭了一个骨架:

scrapy startproject my_crawler_project cd my_crawler_project

进入项目目录后,你会看到一些默认生成的文件和文件夹,比如items.py、pipelines.py、settings.py等。

接下来,我们来创建一个Scrapy爬虫(Spider)。Spider是Scrapy的核心,它定义了如何爬取一个特定网站或一组网站。

scrapy genspider my_first_spider example.com

这个命令会在spiders目录下生成一个名为my_first_spider.py的文件。打开它,你会看到类似这样的结构:

import scrapy

class MyFirstSpiderSpider(scrapy.Spider):

name = "my_first_spider"

allowed_domains = ["example.com"] # 限制爬取范围,防止爬到不相关的网站

start_urls = ["http://www.example.com"] # 爬虫开始抓取的URL

def parse(self, response):

# 这个方法是Scrapy收到响应后默认调用的,用来解析数据

# 这里的response对象包含了网页的内容、状态码等信息

title = response.css('h1::text').get() # 使用CSS选择器提取h1标签的文本

print(f"提取到的标题: {title}")

# 如果需要提取更多数据,可以定义一个Item

# from ..items import MyCrawlerProjectItem # 假设你在items.py定义了MyCrawlerProjectItem

# item = MyCrawlerProjectItem()

# item['title'] = title

# yield item

# 如果需要继续爬取页面中的链接,可以这么做:

# next_page = response.css('a::attr(href)').get()

# if next_page is not None:

# yield response.follow(next_page, callback=self.parse) # 递归调用parse方法在实际操作中,你可能还需要在items.py中定义你想要抓取的数据结构。例如:

# my_crawler_project/items.py

import scrapy

class MyCrawlerProjectItem(scrapy.Item):

# 定义你想要抓取的字段

title = scrapy.Field()

url = scrapy.Field()

content = scrapy.Field()然后回到你的my_first_spider.py中,就可以使用这个Item了。

最后,运行你的爬虫:

scrapy crawl my_first_spider -o output.json

-o output.json会将爬取到的数据保存为JSON格式。初学者可能会觉得这一堆命令有点唬人,但其实熟悉了就发现,Scrapy的骨架搭起来是很快的。关键在于parse方法里的逻辑,那是你和网页内容“对话”的地方。

爬取数据后,如何有效处理和存储?

数据爬下来只是第一步,真正有价值的是你如何把这些原始数据转化成可用的信息。Scrapy的Pipeline(管道)就是为此而生。

Pipeline是处理Item的组件。当一个Item被Spider抓取并yield出来后,它会依次通过你定义的每一个Pipeline。你可以在Pipeline里做很多事情,比如:

- 数据清洗: 去除多余的空格、HTML标签,格式化日期等。

- 数据验证: 检查字段是否为空,数据类型是否正确。

- 去重: 防止重复抓取或存储相同的数据。

- 数据存储: 将数据存入数据库(MySQL, MongoDB等)、文件(CSV, JSON, Excel)或其他存储介质。

要使用Pipeline,你需要在pipelines.py中定义一个类,并实现process_item方法:

# my_crawler_project/pipelines.py

import json

class MyCrawlerProjectPipeline:

def __init__(self):

# 构造函数,可以在这里初始化文件句柄或数据库连接

self.file = open('items.json', 'w', encoding='utf-8')

self.file.write('[')

self.first_item = True

def process_item(self, item, spider):

# 处理每个item

if not self.first_item:

self.file.write(',\n')

line = json.dumps(dict(item), ensure_ascii=False)

self.file.write(line)

self.first_item = False

return item # 记得返回item,这样它才能继续传递给下一个Pipeline

def close_spider(self, spider):

# 爬虫关闭时调用,可以在这里关闭文件或数据库连接

self.file.write(']')

self.file.close()定义好Pipeline后,你需要在settings.py中启用它,并设置优先级(数字越小优先级越高):

# my_crawler_project/settings.py

ITEM_PIPELINES = {

'my_crawler_project.pipelines.MyCrawlerProjectPipeline': 300,

# 如果有其他Pipeline,可以继续添加

}通过Pipeline,你可以将复杂的后处理逻辑模块化,让你的爬虫项目更清晰、更易于维护。比如,我通常会有一个去重Pipeline,一个数据清洗Pipeline,再一个存储到数据库的Pipeline,这样每个环节都各司其职,即便出了问题也方便排查。这比起把所有逻辑都堆在Spider里,简直是天壤之别。

今天带大家了解了的相关知识,希望对你有所帮助;关于文章的技术知识我们会一点点深入介绍,欢迎大家关注golang学习网公众号,一起学习编程~

暴雨救人获谅解,京东表彰外卖小哥

暴雨救人获谅解,京东表彰外卖小哥

- 上一篇

- 暴雨救人获谅解,京东表彰外卖小哥

- 下一篇

- Golang工厂模式几种实现方式对比

-

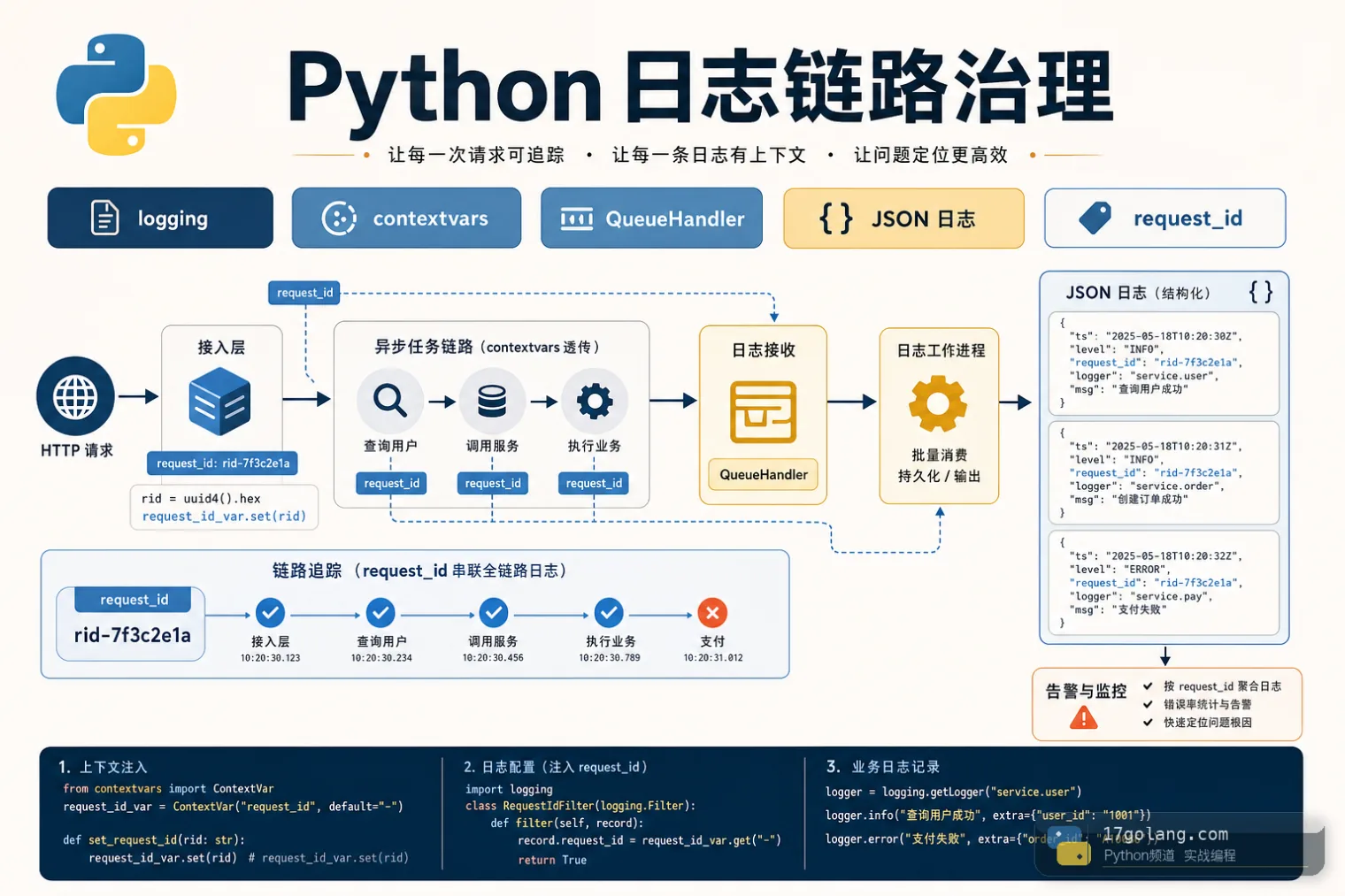

- 文章 · python教程 | 10小时前 | 日志 · 工程化 · 异步编程 · 故障排查 · 可观测性 · Python教程 · Python 异步任务 可观测性 logging contextvars 生产实践 QueueHandler QueueListener request_id JSON日志

- Python 日志实战:别让 request_id 在异步任务里丢了

- 189浏览 收藏

-

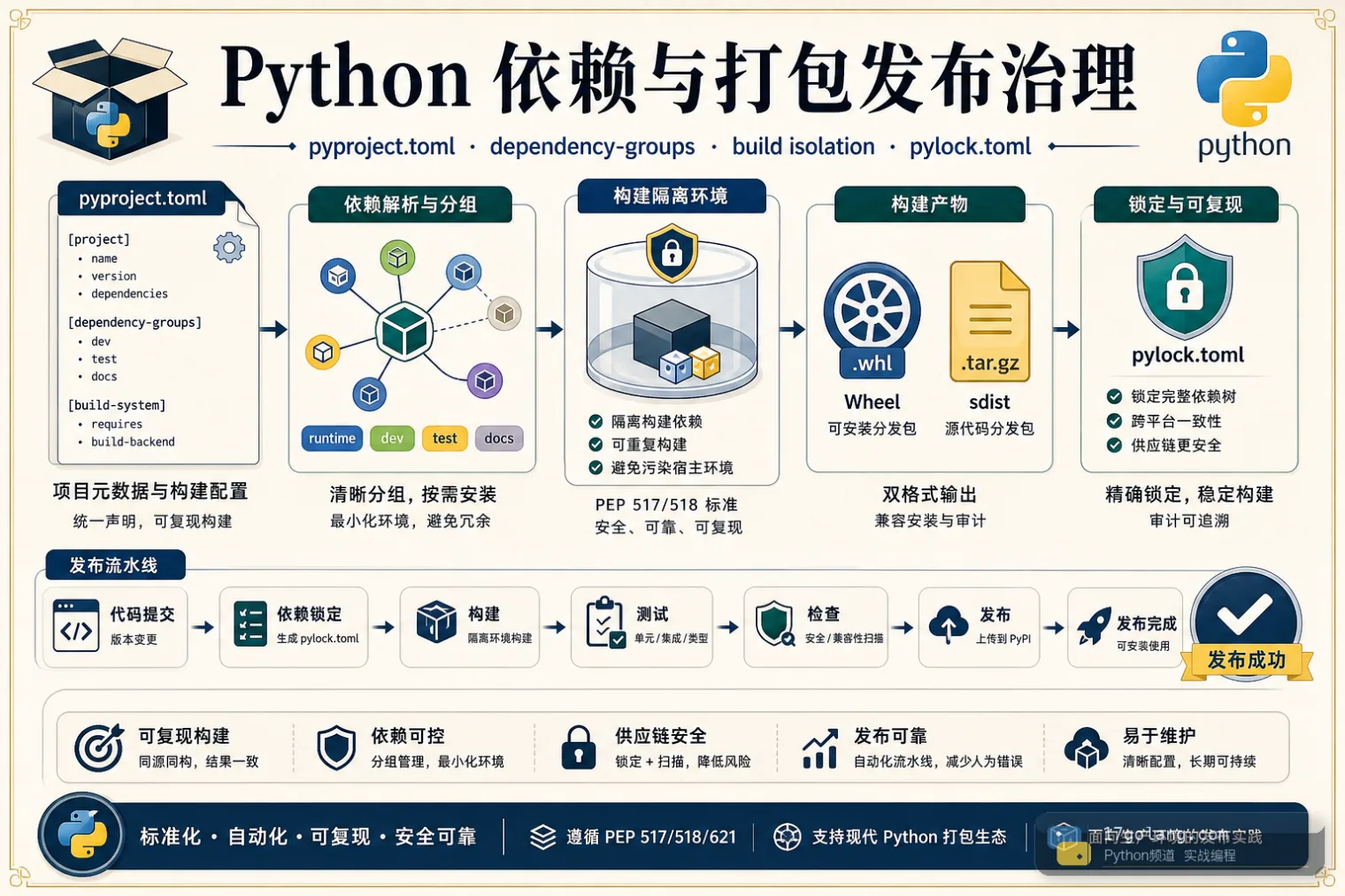

- 文章 · python教程 | 1天前 | 依赖管理 · 工程化 · CI · 生产实践 · Python教程 · 打包发布 · Python build 依赖管理 twine wheel 打包发布 pyproject.toml dependency-groups pylock.toml sdist

- Python 打包发布实战:别把运行依赖和开发依赖混在一起

- 479浏览 收藏

-

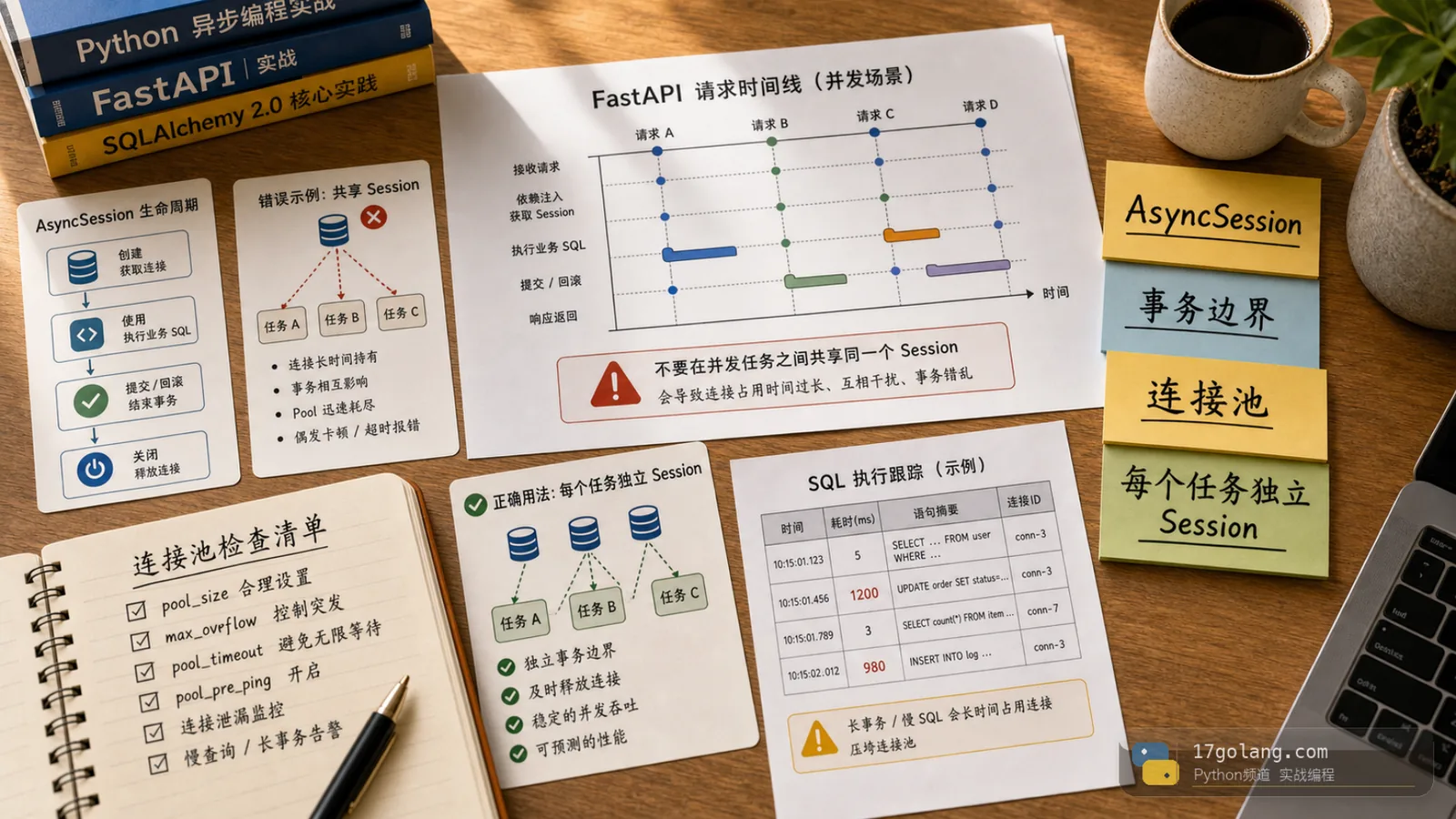

- 文章 · python教程 | 2天前 | sqlalchemy · 异步编程 · fastapi · 生产实践 · Python教程 · Python 连接池 FastAPI sqlalchemy asyncio AsyncSession

- Python SQLAlchemy AsyncSession 实战:别在并发任务里共享 Session

- 340浏览 收藏

-

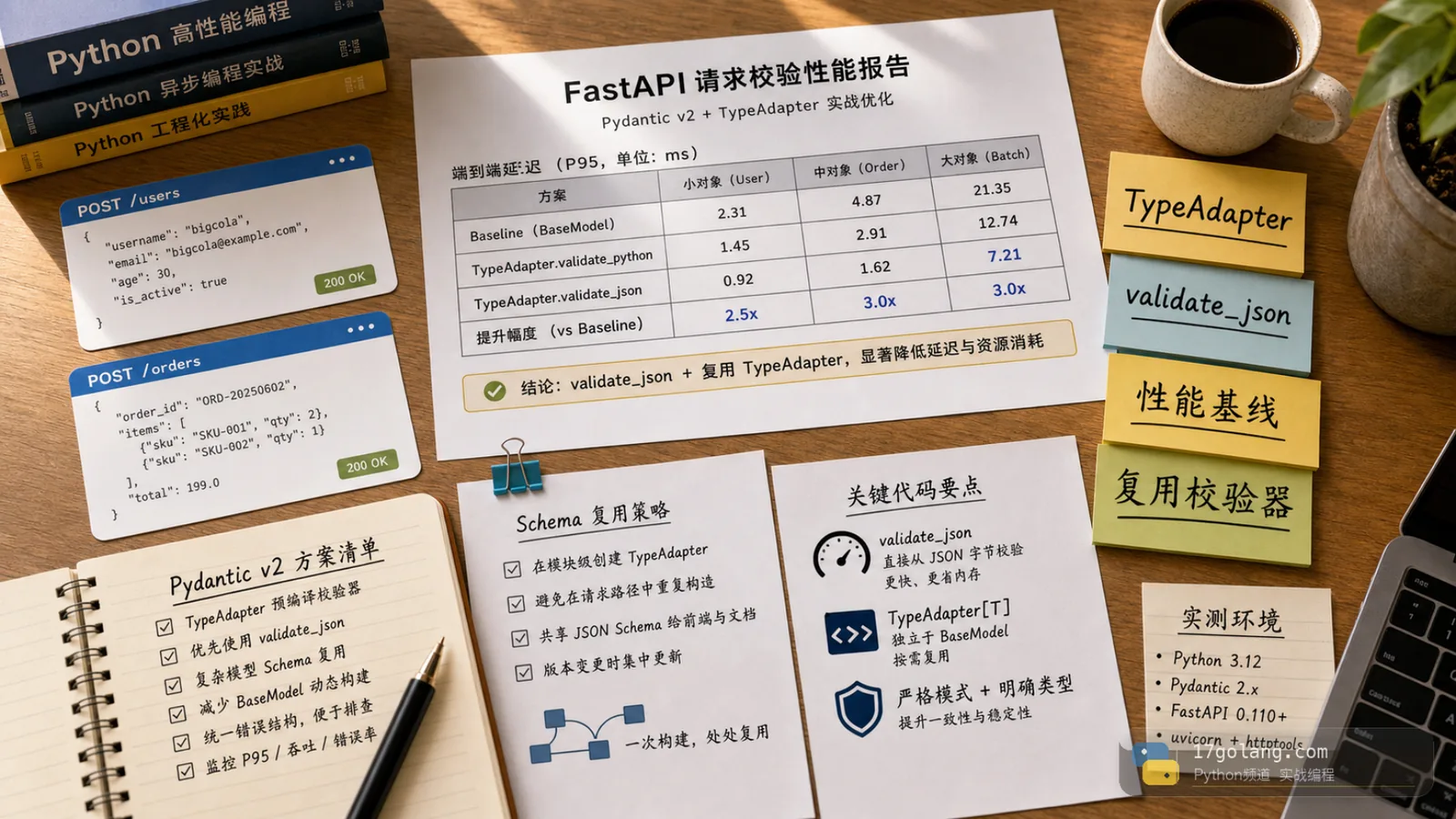

- 文章 · python教程 | 2天前 | 性能优化 · fastapi · 生产实践 · Python教程 · Pydantic · Python 性能优化 FastAPI Pydantic v2 TypeAdapter validate_json

- Python Pydantic v2 实战:TypeAdapter 别在请求里反复造

- 342浏览 收藏

-

- 文章 · python教程 | 4天前 |

- Python手写识别模型训练详解

- 447浏览 收藏

-

- 文章 · python教程 | 4天前 |

- Python递归测试:边界与深度验证指南

- 189浏览 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 6238次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 6657次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 6450次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 8414次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 7072次使用

-

- Flask框架安装技巧:让你的开发更高效

- 2024-01-03 501浏览

-

- Django框架中的并发处理技巧

- 2024-01-22 501浏览

-

- 提升Python包下载速度的方法——正确配置pip的国内源

- 2024-01-17 501浏览

-

- Python与C++:哪个编程语言更适合初学者?

- 2024-03-25 501浏览

-

- 品牌建设技巧

- 2024-04-06 501浏览