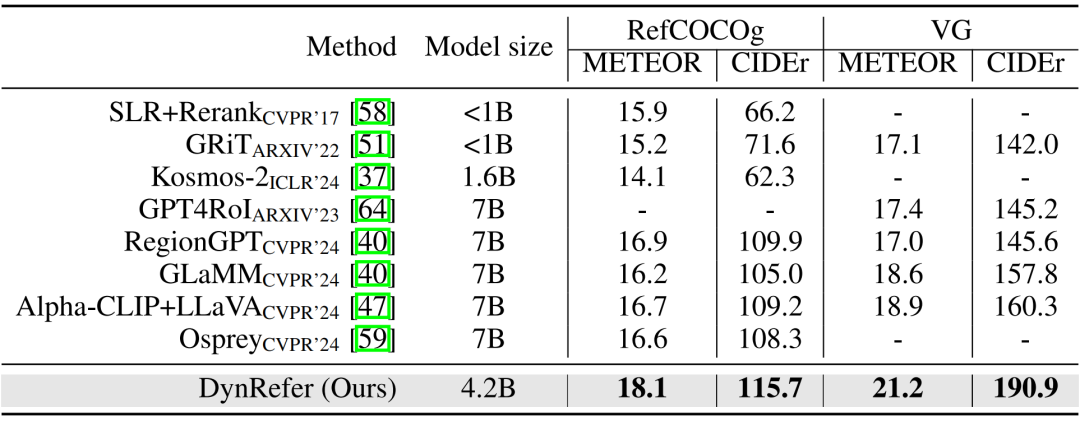

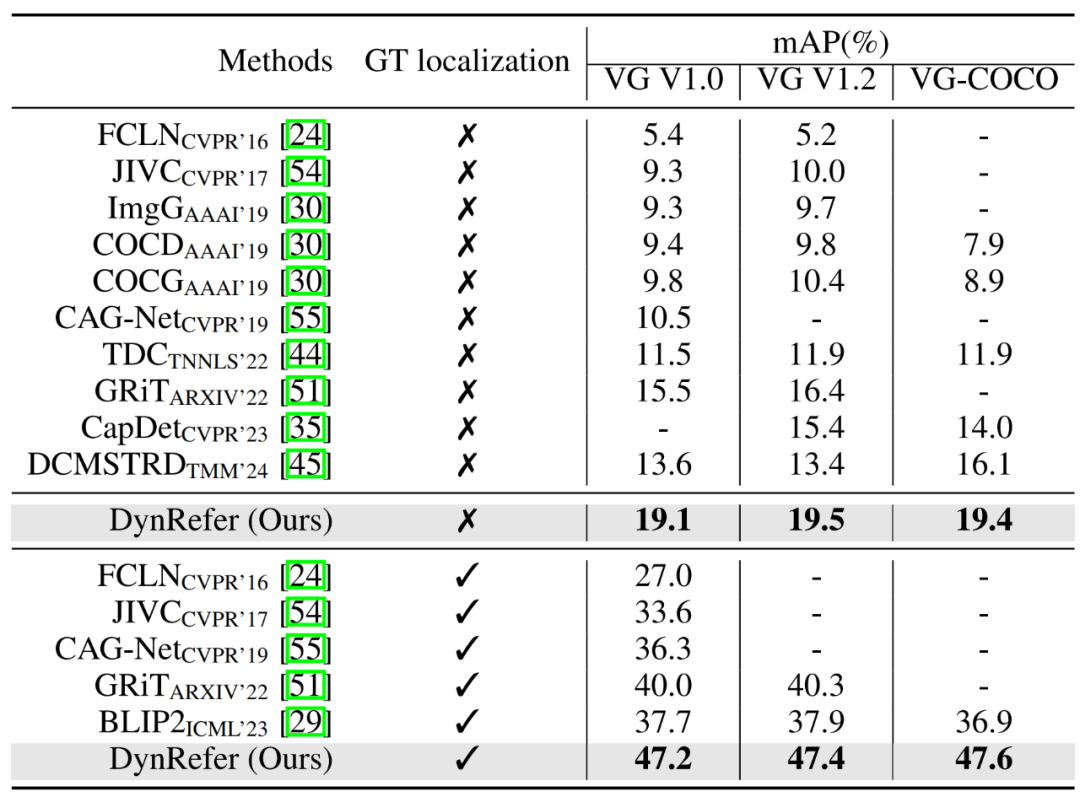

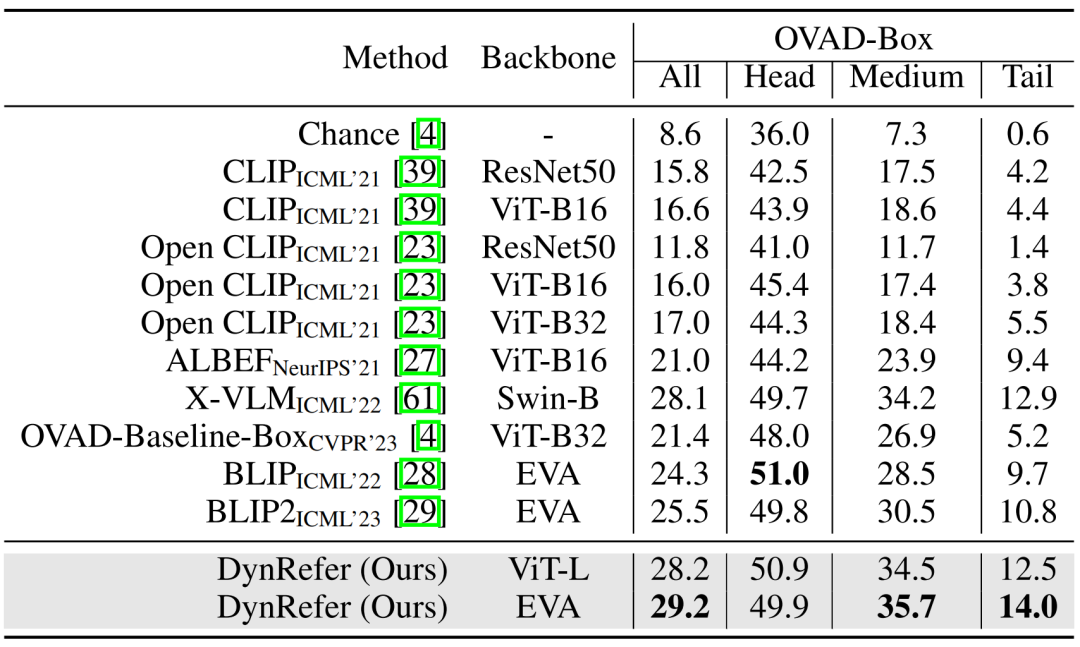

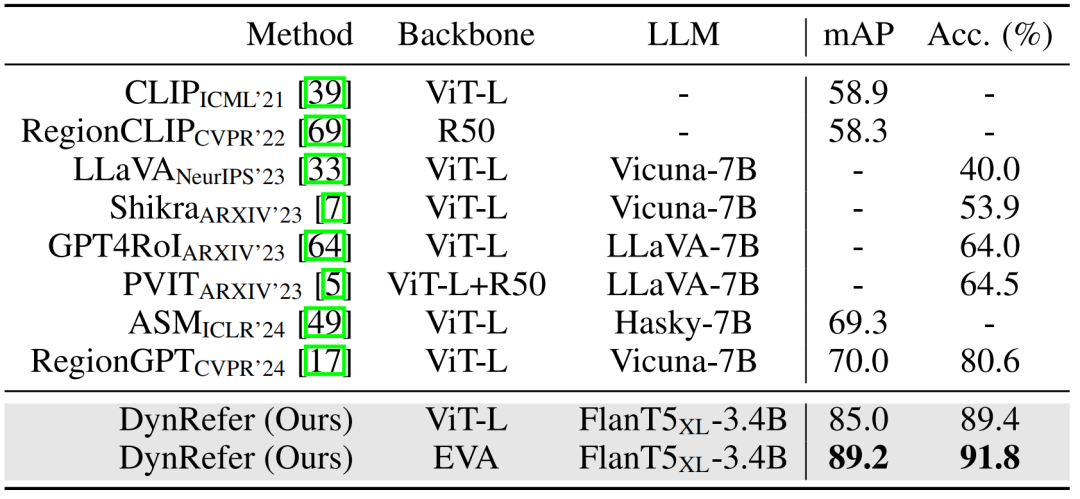

超越CVPR 2024方法,DynRefer在区域级多模态识别任务上,多项SOTA

来源:机器之心

2024-06-20 20:45:31

0浏览

收藏

“纵有疾风来,人生不言弃”,这句话送给正在学习科技周边的朋友们,也希望在阅读本文《超越CVPR 2024方法,DynRefer在区域级多模态识别任务上,多项SOTA》后,能够真的帮助到大家。我也会在后续的文章中,陆续更新科技周边相关的技术文章,有好的建议欢迎大家在评论留言,非常感谢!

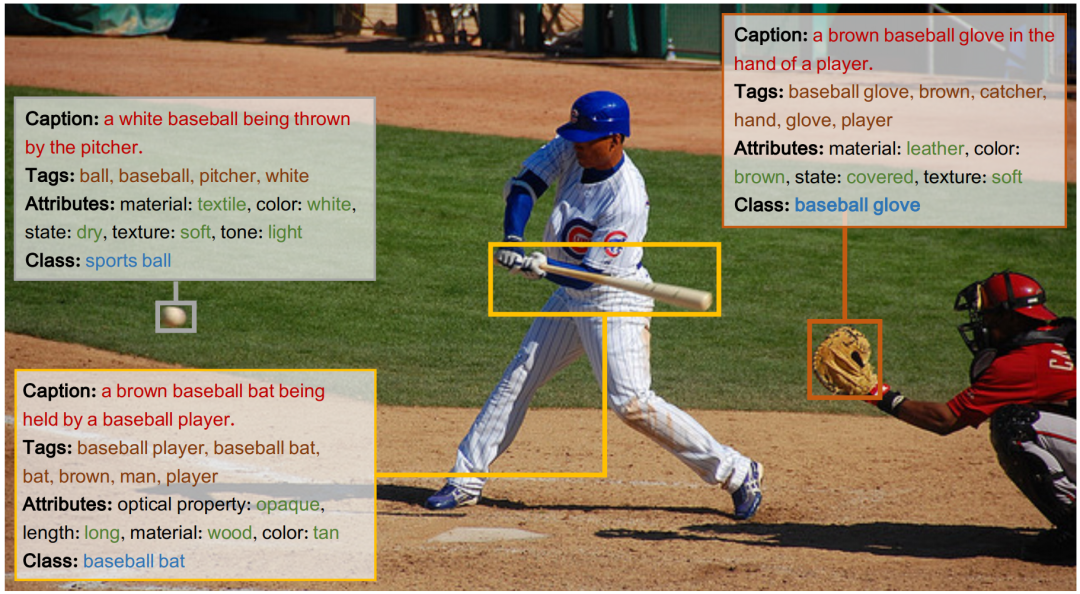

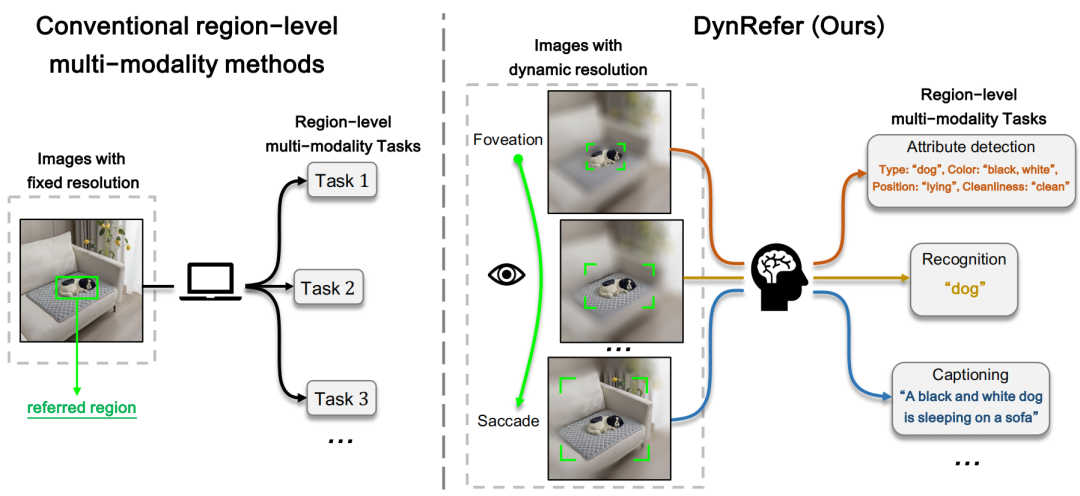

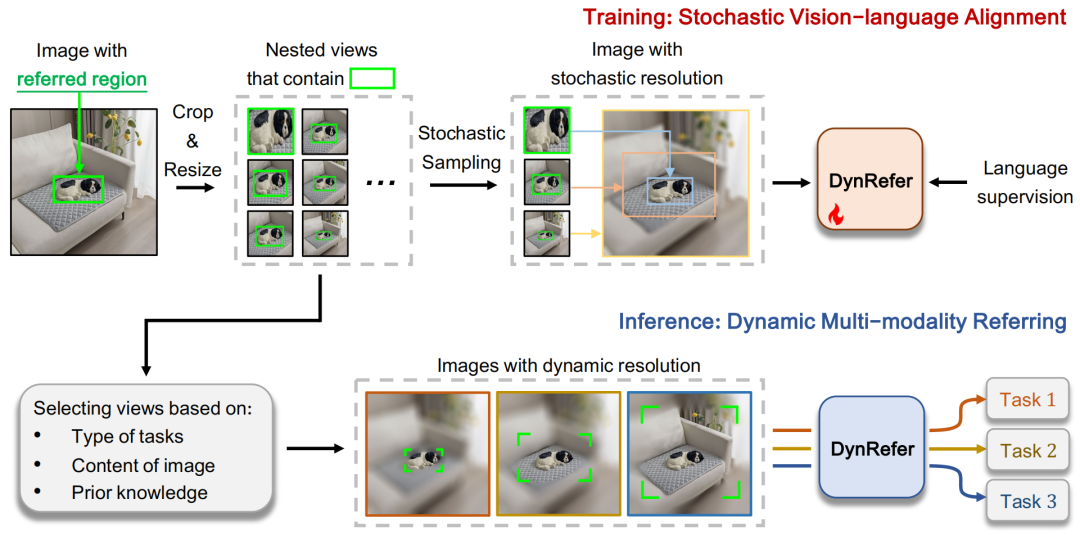

为了实现高精度的区域级多模态理解,本文提出了一种动态分辨率方案来模拟人类视觉认知系统。

本文作者来自中国科学院大学LAMP实验室,其中第一作者赵毓钟是中国科学院大学2023级博士生,共同作者刘峰是中国科学院大学2020级直博生。他们的主要研究方向是视觉语言模型和视觉目标感知。

论文标题:DynRefer: Delving into Region-level Multi-modality Tasks via Dynamic Resolution 论文链接:https://arxiv.org/abs/2405.16071 论文代码:https://github.com/callsys/DynRefer

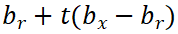

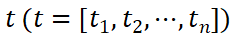

,其中

,其中 。这里的

。这里的 表示参考区域的边界框,

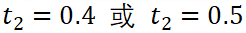

表示参考区域的边界框, 表示整个图像的尺寸,t 表示插值系数。在训练过程中,我们从候选视图中随机选择 n 个视图,以模拟由于注视和眼球快速运动而生成的图像。这些 n 个视图对应于插值系数 t,即

表示整个图像的尺寸,t 表示插值系数。在训练过程中,我们从候选视图中随机选择 n 个视图,以模拟由于注视和眼球快速运动而生成的图像。这些 n 个视图对应于插值系数 t,即 。我们固定保留仅包含参考区域的视图(即

。我们固定保留仅包含参考区域的视图(即 )。经实验证明该视图有助于保留区域细节,对于所有区域多模态任务都至关重要。

)。经实验证明该视图有助于保留区域细节,对于所有区域多模态任务都至关重要。

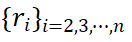

。如图 3 左侧所示。由于裁剪、调整大小和 RoI-Align 引入的空间误差,这些区域嵌入在空间上并不对齐。受 deformable convolution 操作启发,我们提出了一个对齐模块,通过将

。如图 3 左侧所示。由于裁剪、调整大小和 RoI-Align 引入的空间误差,这些区域嵌入在空间上并不对齐。受 deformable convolution 操作启发,我们提出了一个对齐模块,通过将  对齐到

对齐到  来减少偏差,其中

来减少偏差,其中  是仅包含参考区域的视图编码的区域嵌入。对于每个区域嵌入

是仅包含参考区域的视图编码的区域嵌入。对于每个区域嵌入 ,首先将其与

,首先将其与  连接,然后通过卷积层计算一个二维偏移图。

连接,然后通过卷积层计算一个二维偏移图。 的空间特征然后根据二维偏移重新采样。最后,对齐后的区域嵌入沿通道维度连接并通过 linear 层进行融合。输出进一步通过视觉重采样模块,即 Q-former,进行压缩,从而提取原始图像 x 的参考区域

的空间特征然后根据二维偏移重新采样。最后,对齐后的区域嵌入沿通道维度连接并通过 linear 层进行融合。输出进一步通过视觉重采样模块,即 Q-former,进行压缩,从而提取原始图像 x 的参考区域  的区域表示(图 3 中的

的区域表示(图 3 中的 )。

)。

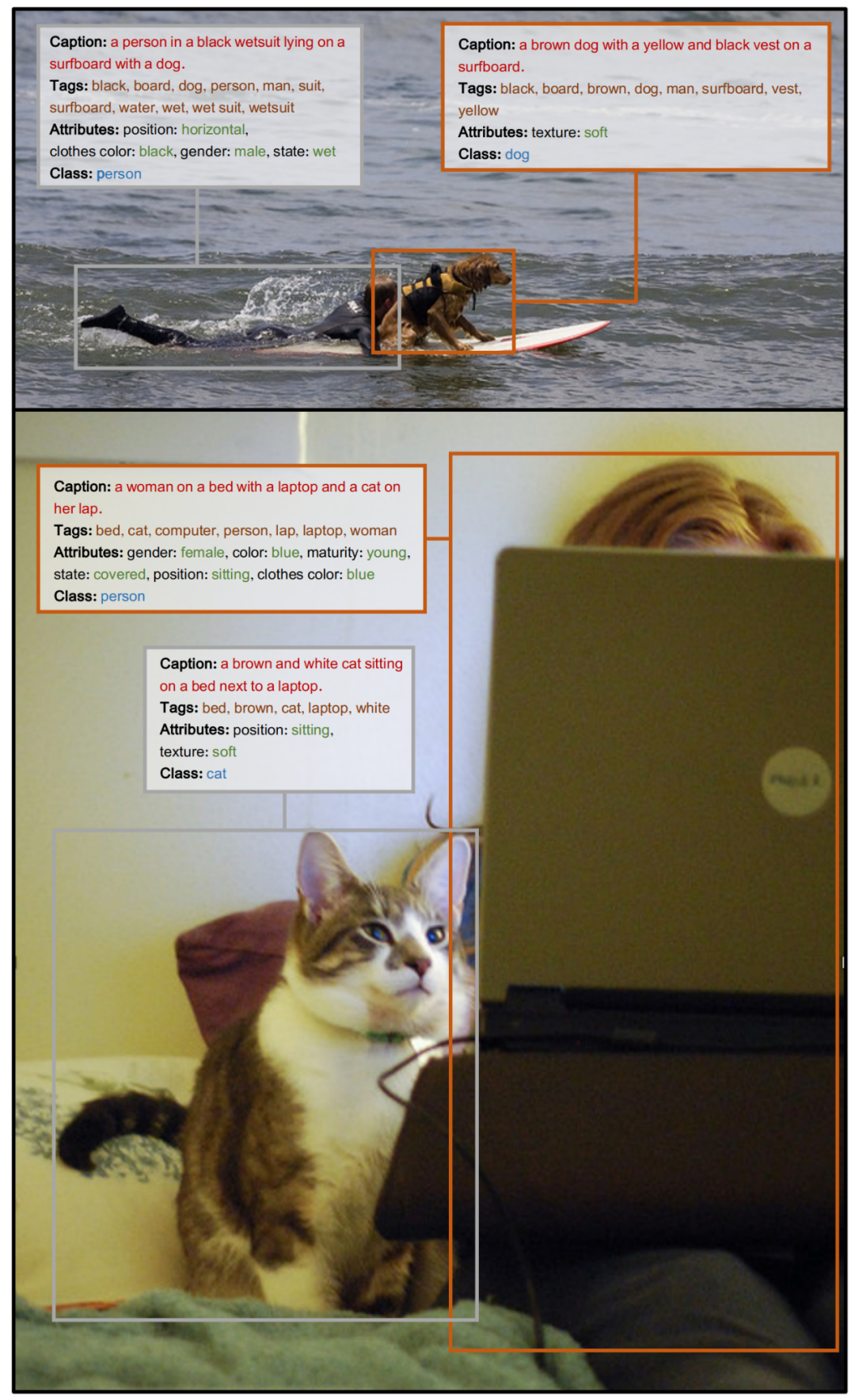

,由三个解码器

,由三个解码器 解码,如图 3(右)所示,分别受三个多模态任务的监督:

解码,如图 3(右)所示,分别受三个多模态任务的监督: 如图 3(右侧)所示。通过使用标签作为查询,

如图 3(右侧)所示。通过使用标签作为查询, 作为键和值,计算预定义标记的置信度来完成标记过程。我们从真值字幕中解析出标签,以监督识别解码器。ii) 区域 - 文本对比学习。类似于区域标记解码器,解码器

作为键和值,计算预定义标记的置信度来完成标记过程。我们从真值字幕中解析出标签,以监督识别解码器。ii) 区域 - 文本对比学习。类似于区域标记解码器,解码器  定义为基于查询的识别解码器。该解码器计算字幕与区域特征之间的相似性分数,使用 SigLIP loss 进行监督。iii) 语言建模。我们采用预训练的大语言模型

定义为基于查询的识别解码器。该解码器计算字幕与区域特征之间的相似性分数,使用 SigLIP loss 进行监督。iii) 语言建模。我们采用预训练的大语言模型  将区域表示

将区域表示  转换为语言描述。

转换为语言描述。

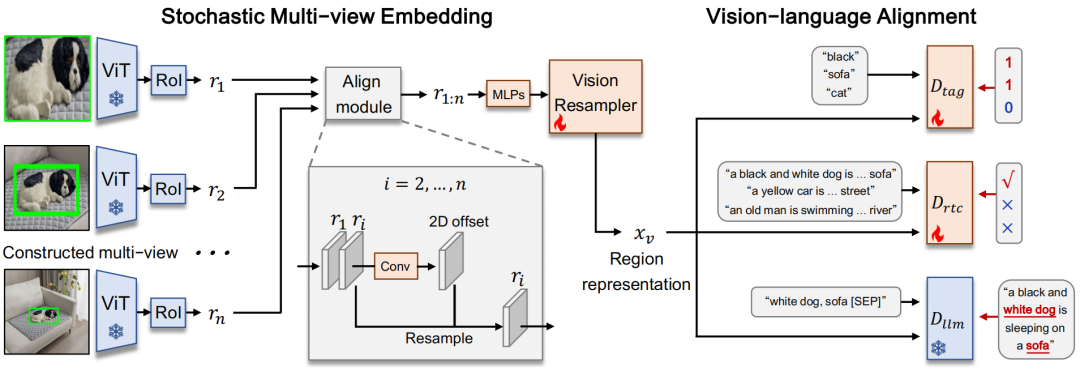

。视图一是固定的(

。视图一是固定的( ),视图二随机选择或固定。

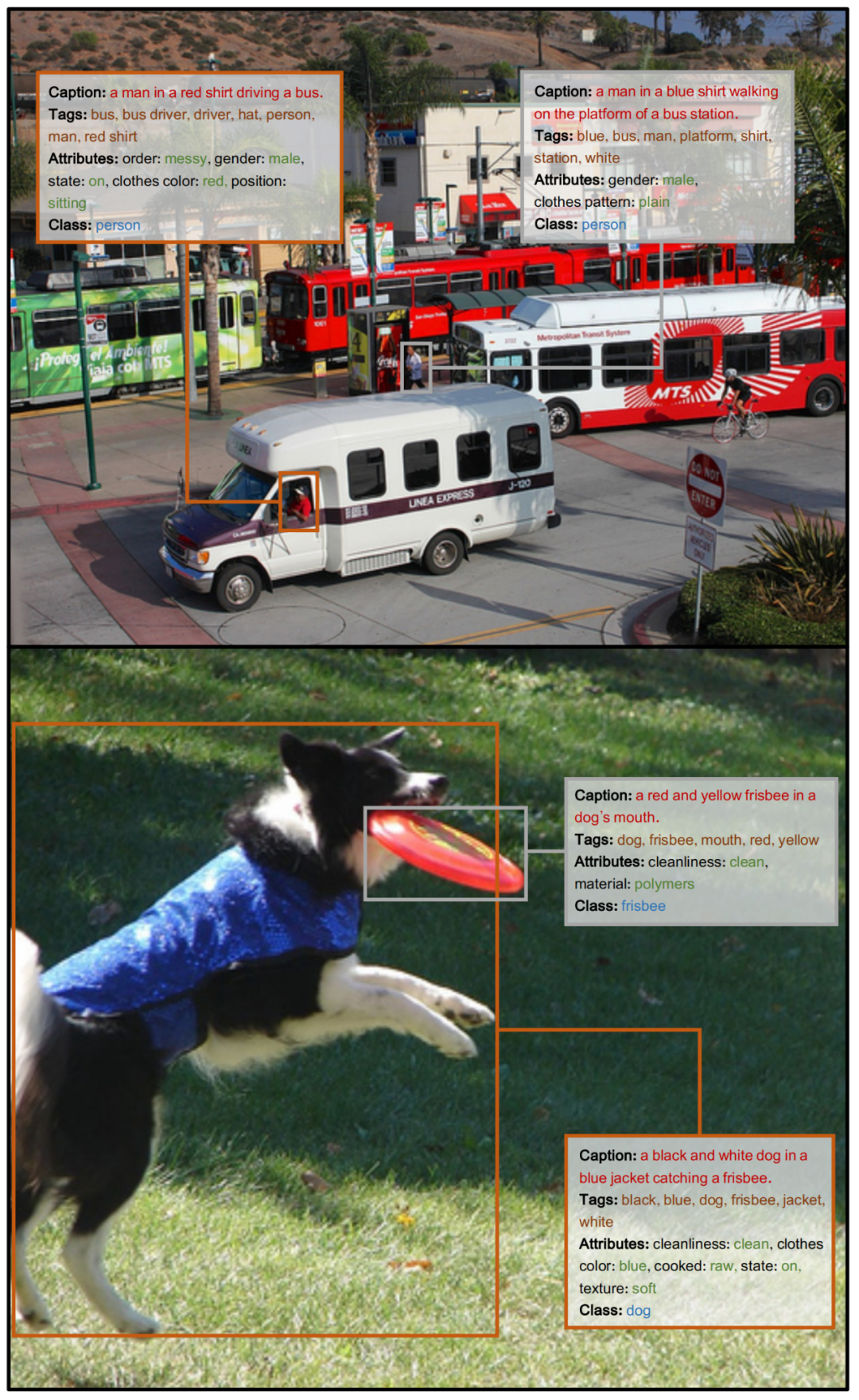

),视图二随机选择或固定。 ,我们可以得到具有动态分辨率特性的区域表示。为了评估不同动态分辨率下的特性,我们训练了一个双视图(n=2)的 DynRefer 模型,并在四个多模态任务上进行评估。从图 4 中的曲线可以看出,对于没有上下文信息的视图(

,我们可以得到具有动态分辨率特性的区域表示。为了评估不同动态分辨率下的特性,我们训练了一个双视图(n=2)的 DynRefer 模型,并在四个多模态任务上进行评估。从图 4 中的曲线可以看出,对于没有上下文信息的视图( ),属性检测(Attribute detection)获得了更好的结果。这可以解释为这种任务通常需要详细的区域信息。而对于区域级字幕(Region-level captioning)和密集字幕生成(Dense captioning)任务,需要上下文丰富的视图(

),属性检测(Attribute detection)获得了更好的结果。这可以解释为这种任务通常需要详细的区域信息。而对于区域级字幕(Region-level captioning)和密集字幕生成(Dense captioning)任务,需要上下文丰富的视图(  ),以便完整理解参考区域。需要注意的是,过多上下文的视图(

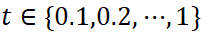

),以便完整理解参考区域。需要注意的是,过多上下文的视图( )会降低所有任务的性能,因为它们引入了过多与区域无关的信息。当已知任务类型时,我们可以根据任务特性采样适当的视图。当任务类型未知时,我们首先构建一组在不同插值系数 t 下的候选视图集合,

)会降低所有任务的性能,因为它们引入了过多与区域无关的信息。当已知任务类型时,我们可以根据任务特性采样适当的视图。当任务类型未知时,我们首先构建一组在不同插值系数 t 下的候选视图集合, 。从候选集中,通过贪婪搜索算法采样 n 个视图。搜索的目标函数定义为:

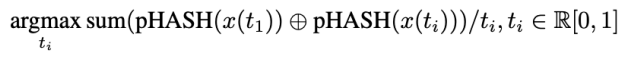

。从候选集中,通过贪婪搜索算法采样 n 个视图。搜索的目标函数定义为: 其中

其中 表示第 i 个视图的插值系数,

表示第 i 个视图的插值系数, 表示第 i 个视图,pHASH (・) 表示感知图像哈希函数,

表示第 i 个视图,pHASH (・) 表示感知图像哈希函数, 表示异或操作。为了从全局视角比较视图的信息,我们利用 "pHASH (・)" 函数将视图从空间域转换到频域,然后编码成哈希码。对于

表示异或操作。为了从全局视角比较视图的信息,我们利用 "pHASH (・)" 函数将视图从空间域转换到频域,然后编码成哈希码。对于 这一项,我们减少上下文丰富视图的权重,以避免引入过多冗余信息。

这一项,我们减少上下文丰富视图的权重,以避免引入过多冗余信息。

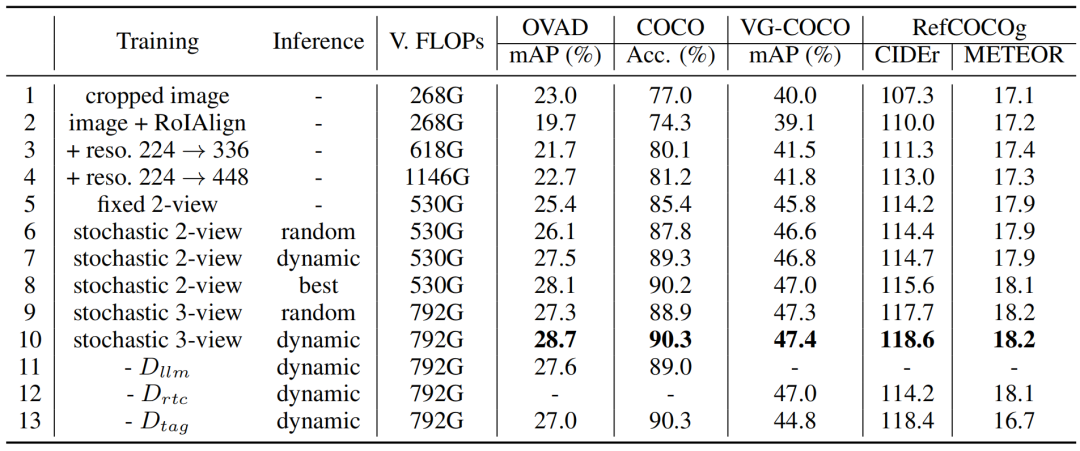

Line 1-6:随机动态多视图要优于固定视图。 Line 6-10:通过最大化信息选择视图优于随机选择视图。 Line 10-13:多任务训练可以学习得到更好的区域表征。

以上就是《超越CVPR 2024方法,DynRefer在区域级多模态识别任务上,多项SOTA》的详细内容,更多关于产业,DynRefer的资料请关注golang学习网公众号!

版本声明

本文转载于:机器之心 如有侵犯,请联系study_golang@163.com删除

蔚来被曝重组智驾团队,端到端大模型助力高阶智能驾驶

蔚来被曝重组智驾团队,端到端大模型助力高阶智能驾驶

- 上一篇

- 蔚来被曝重组智驾团队,端到端大模型助力高阶智能驾驶

- 下一篇

- 3C数码企业新用户同比增长40% 京东3C数码企业及商采618完美收官

查看更多

最新文章

-

- 科技周边 · 人工智能 | 1小时前 | DeepSeek

- DeepSeek能做用户调研吗?

- 481浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 | QClaw

- QClaw部署依赖与环境配置教程

- 287浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 |

- AI文生图软件推荐,哪个最实用?

- 295浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 | Midjourney

- Midjourney生成神明威严氛围技巧

- 266浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 |

- AirPods Pro 3优化设置指南

- 249浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 | 豆包AI 豆包AI助手

- 豆包AI翻译商务邮件教程

- 103浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 | openclaw

- OpenClaw智能生成商品文案教程

- 200浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 |

- 如何查阅Vue 3组合式API最新用法?

- 432浏览 收藏

-

- 科技周边 · 人工智能 | 1小时前 | 豆包AI 豆包AI助手

- 豆包AI用户增长技巧与方法教程

- 491浏览 收藏

-

- 科技周边 · 人工智能 | 2小时前 | 千问AI购物助手

- 千问AI购物助手选色号攻略

- 131浏览 收藏

-

- 科技周边 · 人工智能 | 2小时前 |

- DeepSeek V4助你生成合规理财话术与风险提示

- 364浏览 收藏

查看更多

课程推荐

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

查看更多

AI推荐

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 4517次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 4869次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 4743次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 6602次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 5104次使用

查看更多

相关文章

-

- GPT-4王者加冕!读图做题性能炸天,凭自己就能考上斯坦福

- 2023-04-25 501浏览

-

- 单块V100训练模型提速72倍!尤洋团队新成果获AAAI 2023杰出论文奖

- 2023-04-24 501浏览

-

- ChatGPT 真的会接管世界吗?

- 2023-04-13 501浏览

-

- VR的终极形态是「假眼」?Neuralink前联合创始人掏出新产品:科学之眼!

- 2023-04-30 501浏览

-

- 实现实时制造可视性优势有哪些?

- 2023-04-15 501浏览