8B文字多模态大模型指标逼近GPT4V,字节、华师、华科联合提出TextSquare

亲爱的编程学习爱好者,如果你点开了这篇文章,说明你对《8B文字多模态大模型指标逼近GPT4V,字节、华师、华科联合提出TextSquare》很感兴趣。本篇文章就来给大家详细解析一下,主要介绍一下,希望所有认真读完的童鞋们,都有实质性的提高。

AIxiv专栏是本站发布学术、技术内容的栏目。 过去几年,本站AIxiv专栏接收报道道约2000多篇内容,覆盖全球各大高校与企业的顶级实验室,有效促进了学术交流与传播。如果您有优秀的工作想要分享,欢迎投稿或者联系报道邮箱。投稿邮箱:liyazhou@jiqizhixin.com;zhaoyunfeng@jiqizhixin.com。

近期,多模态大模型(MLLM)在文本中心的VQA领域取得了显著进展,尤其是多个闭源模型,例如:GPT4V 和 Gemini,甚至在某些方面展现了超越人类能力的表现。但是,开源模型的性能还远远落后于闭源模型,最近许多开创性的研究,例如:MonKey、LLaVAR、TG-Doc、ShareGPT4V 等已经开始关注指令微调数据不足的问题。尽管这些努力取得了显著的效果,但仍存在一些问题,图像描述数据和 VQA 数据属于不同的领域,图像内容呈现的粒度和范围存在不一致性。此外,合成数据的规模相对较小,使得 MLLM 无法充分发挥潜力。

论文标题:TextSquare: Scaling up Text-Centric Visual Instruction Tuning

论文地址:https://arxiv.org/abs/2404.12803

为了减少这一

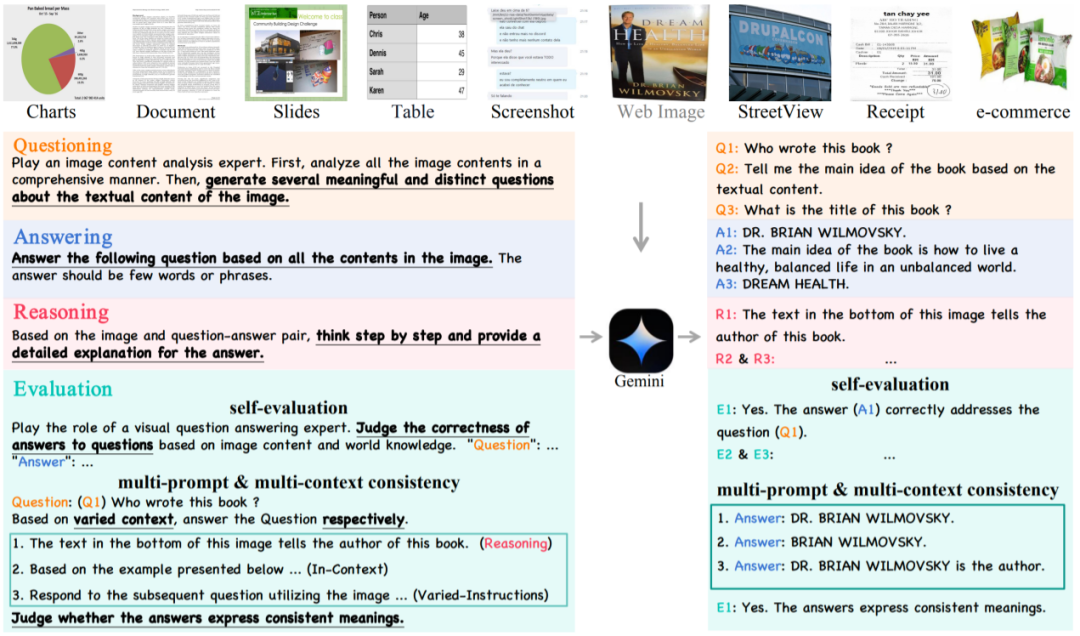

VQA 数据生成

Square+ 策略方法包括四个步骤:自问 (Self-Questioning)、回答 (Self-Answering)、推理 (Self-Reasoning) 和评估 (Self-Evaluation)。Self-Questioning 利用MLLM 在文本图像分析和理解方面的能力生成与图像中文本内容相关的问题。Self-Answering 利用各种提示技术,如:思维链 CoT 和少样本,提供回答这些问题。Self-Reasoning 利用MLLMs 强大的推理能力,生成模型背后的推理过程。Self-Evaluation 评估问题的有效性、与图像文本内容的相关性以及答案的准确性,从而提高数据质量并减少偏见。

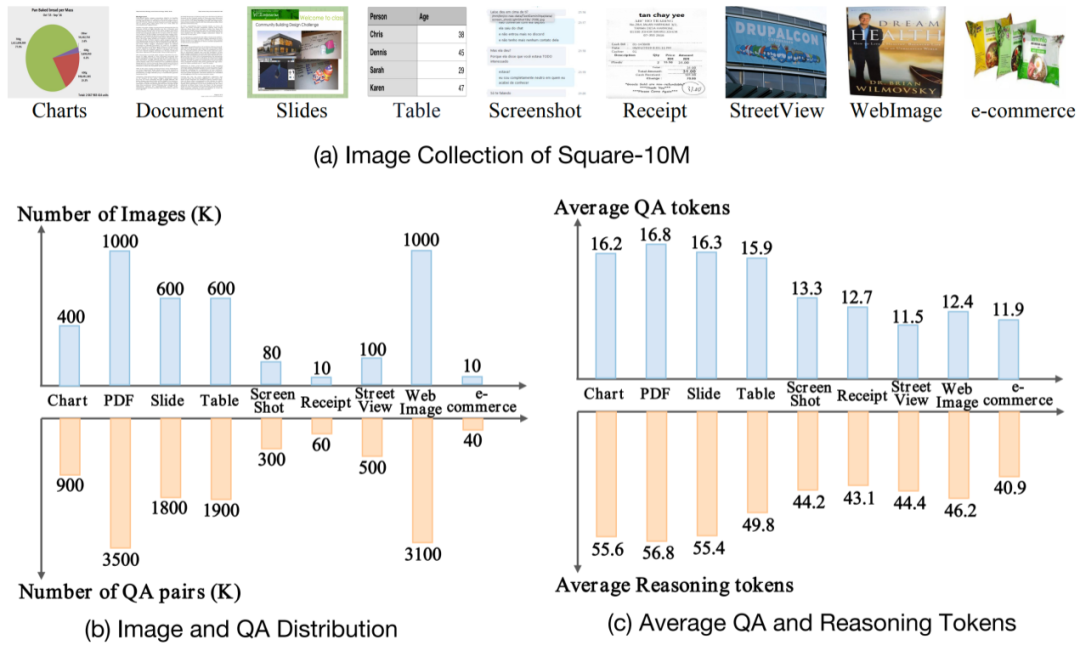

基于 Square 方法,研究者从各种公共来源收集了一组多样化的含有大量文本的图像,包括自然场景、图表、表单、收据、书籍、PPT、PDF 等构建了 Square-10M,并基于这个数据集训练了以文本理解为中心的 MLLM TextSquare-8B。

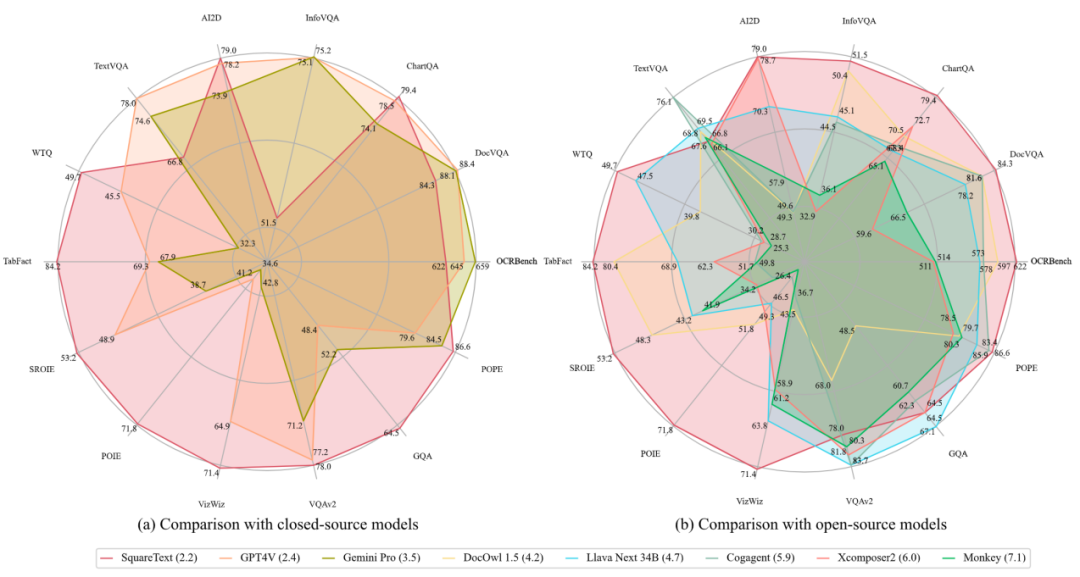

如图 1 所示,TextSquare-8B 在多个 benchmark 可取得与 GPT4V 和 Gemini 相媲美或更优的效果,并显著超过了其他开源模型。TextSquare 实验验证了推理数据对 VQA 任务的积极影响,证明了其能够在减少幻觉的同时提升模型性能。

此外,通过利用大规模的数据集,揭示了指令调整数据规模、训练收敛损失和模型性能之间的关系。尽管少量的指令调整数据可以很好地训练 MLLM,随着指令调整数据的不断扩大,模型的性能能得到进一步增长,指令微调数据和模型之间也存在着相对应的 scaling law。

图 3 Square-10M 的图像分布和 QA 分布等详细情况

数据收集

数据收集策略的主要目标是涵盖广泛的现实世界文本丰富的场景。为此,研究者收集了 380 万张的富文本的图像。这些图像表现出不同的特性,例如,图表和表格侧重于具有密集统计信息的文本元素;PPT、屏幕截图和 WebImage 是为文本和突出视觉信息之间的交互而设计的;文档 / PDF、收据和电子商务包含具有精细和密集文本的图像;街景源于自然场景。收集到的图像形成了现实世界中文本元素的映射,并构成了研究以文本为中心的 VQA 的基础。

数据生成

研究者利用 Gemini Pro 的多模态理解能力从特定数据源选择图像,并通过自问、自答、自我推理三个阶段生成 VQA 及推理上下文对。

Self-Question: 这个阶段会给定一些 prompt,Gemini Pro 会根据这些提示对图像进行全面分析,并根据理解去生成一些有意义的问题。考虑到通用 MLLM 对文本元素的理解能力通常会比视觉模型弱,我们通过专门的 OCR 模型将提取的文本预处理到 prompt 中去。

Self-Answering: Gemini Pro对生成问题会利用思维链 (CoT) 和少样本提示 (few-shot prompting) 等技术丰富上下文信息,提高生成答案的可靠性。

Self-Reasoning: 这个阶段会生成答案的详细原因,迫使 Gemini Pro 更多的思考问题和视觉元素之间的联系,从而减少幻觉并提高准确的答案。

数据过滤

尽管自我提问、回答和推理是有效的,但生成的图像 - 文本对可能面临幻觉内容、无意义问题和错误答案。因此,我们设计了基于 LLM 的评估能力的过滤规则,以选择高质量的 VQA 对。

Self-Evaluation 提示 Gemini Pro 和其他 MLLMs 判断生成的问题是否有意义,以及答案是否足以正确解决问题。

Multi-Prompt Consistency 除了直接评估生成的内容外,研究者还在数据生成中手动增加提示和上下文空间。当提供不同的提示时,一个正确且有意义的 VQA 对应该在语义上一致。

Multi-Context Consistency 研究者通过在问题前准备不同的上下文信息来进一步验证 VQA 对。

TextSquare-8B

TextSquare-8B 借鉴了 InternLM-Xcomposer2 的模型结构,包括 CLIP ViT-L-14-336 的视觉 Encoder,图像分辨率进一步提升至 700;基于 InternLM2-7B-ChatSFT 的大语言模型 LLM;一个对齐视觉和文本 token 的桥接器 projector。

TextSquare-8B 的训练包括三阶段的 SFT:

第一阶段,以 490 的分辨率全参数 (Vision Encoder, Projector, LLM) 微调模型。

第二阶段,输入分辨率增加到 700,只训练 Vision Encoder 以适应分辨率变化。

第三阶段,进一步以 700 的分辨率进行全参数微调。

TextSquare 证实,在 Square-10M 数据集的基础上,具有 8B 参数和正常大小图像分辨率的模型可以在以文本为中心的 VQA 上实现超过了大多数的 MLLM,甚至是闭源模型 (GPT4V、Gemini Pro) 的效果。

实验结果

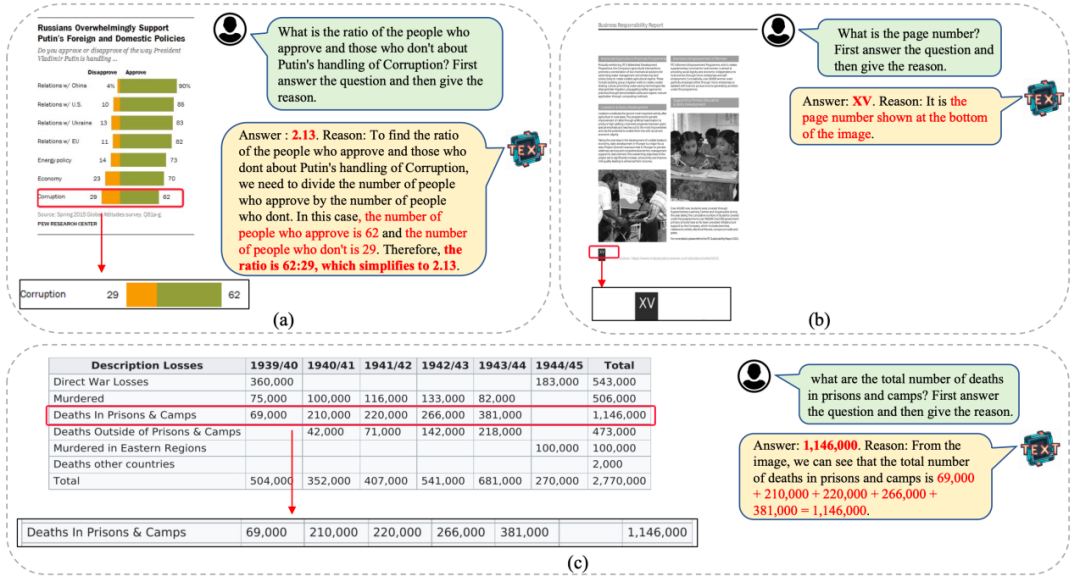

图 4(a)显示 TextSquare 具有简单的算术功能。图 4(b)显示了理解文本内容并在密集文本中提供大致位置的能力。图 4(c)显示了 TextSquare 对表格结构的理解能力。

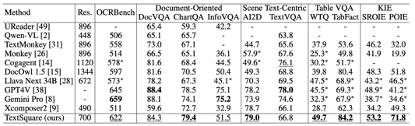

MLLM Benchmark

Document-Oriented Benchmark 在文档场景的 VQA Benckmark (DocVQA、ChartQA、InfographicVQA) 上平均提升 3.5%,优于所有开源模型,在 ChartQA 数据集上略高于 GPT4V 和 Gemini Pro,该模型分辨率仅 700,小于大多数面向文档的 MLLM,如果分辨率进一步提高,相信模型性能也将进一步提高,Monkey 已证明这一点。

Scene Text-centric Benchmark 自然场景的 VQA Benchmark (TextVQA、AI2D) 中取得了 SOTA 的效果,但与 baseline Xcomposer2 相比没有较大改进,可能是因为 Xcomposer2 已经用了高质量的域内数据进行了充分优化。

Table VQA Benchmark 表格场景的 VQA Benchmark (WTQ、TabFact) 中取得到远超 GPT4V 及 Gemini Pro 的效果,分别超过其他 SOTA 模型 3%。

Text-centric KIE Benchmark 文本中心的关键信息提取 KIE 任务的 benchmark (SROIE、POIE),将 KIE 任务转换成 VQA 任务,在两个数据集都取得了最佳的性能,平均提升 14.8%。

OCRBench 包括文本识别、公式识别、文本中心 VQA、KIE 等 29 项 OCR 相关的评估任务,取得了开源模型的最佳性能,并成为第一个 10B 左右参数量达到 600 分的模型。

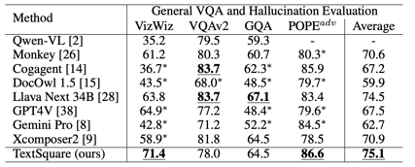

General VQA and Hallucination Evaluation Benchmark 在通用的 VQA Benchmark (VizWiz VQAv2、GQA、POPE) 上 TextSquare 相较于 Xconposer2 没有显著退化,仍然保持着最佳的性能,在 VisWiz 和 POPE 表现出显著的性能,比各最佳的方法高出 3.6%,这突出了该方法的有效性,能减轻模型幻觉。

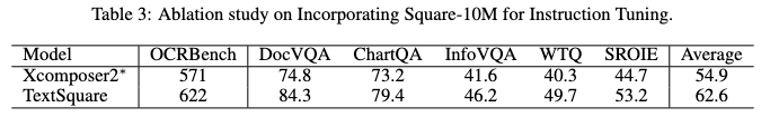

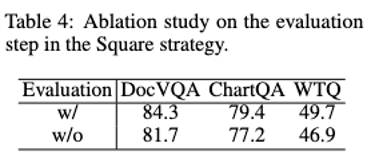

消融实验

TextSquare 相较于 Xcomposer2 在各 benchmark 平均提升 7.7%。

加入自评估后,模型性能有了明显提升。

加入推理数据后有助于显著提升性能以及减轻幻觉生成。

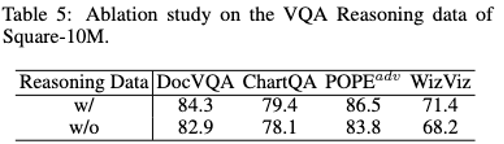

数据规模和收敛 loss & 模型性能关系

随着数据规模的增长,模型的 loss 继续减少,而下降速度逐渐变慢。收敛损失和指令调整数据尺度之间的关系近似符合对数函数。

随着指令调优数据的增长,模型的性能越来越好,但增长速度继续放缓,也大致符合对数函数。

总体而言,在以文本为中心的 VQA 场景中,在指令调整阶段存在相应的缩放定律,其中模型性能与数据缩放的对数成正比,可以指导潜在更大数据集的构建并预测模型性能。

总结

在本文中,研究者提出了构建高质量的以文本为中心的指令调优数据集(Square-10M)的 Square 策略,利用该数据集,TextSquare-8B 在多个 benchmark 上实现了与 GPT4V 相当的性能,并在各种基准测试上大幅优于最近发布的开源模型。

此外,研究者推导了指令调整数据集规模、收敛损失和模型性能之间的关系,以便为构建更大的数据集铺平道路,证实了数据的数量和质量对模型性能至关重要。

最后,研究者指出,如何进一步提高数据数量和质量以缩小开源模型与领先模型之间的差距,被认为一个有高度希望的研究方向。

好了,本文到此结束,带大家了解了《8B文字多模态大模型指标逼近GPT4V,字节、华师、华科联合提出TextSquare》,希望本文对你有所帮助!关注golang学习网公众号,给大家分享更多科技周边知识!

如何在 Golang 中使用 Olivere 将数据插入 Elasticsearch

如何在 Golang 中使用 Olivere 将数据插入 Elasticsearch

- 上一篇

- 如何在 Golang 中使用 Olivere 将数据插入 Elasticsearch

- 下一篇

- golang找不到本地路径的模块

-

- 科技周边 · 人工智能 | 5小时前 | 哩布哩布AI

- 哩布哩布AI控制网添加方法详解

- 270浏览 收藏

-

- 科技周边 · 人工智能 | 5小时前 | 火山方舟

- 局域网共享方舟代理配置教程

- 315浏览 收藏

-

- 科技周边 · 人工智能 | 5小时前 |

- Perplexity切换Claude3.5Pro方法详解

- 138浏览 收藏

-

- 科技周边 · 人工智能 | 5小时前 |

- Deepseek满血版与Lumen5轻松制作营销短视频

- 323浏览 收藏

-

- 科技周边 · 人工智能 | 5小时前 | 夸克AI 夸克AI大模型

- 夸克AI翻译技巧全解析

- 265浏览 收藏

-

- 科技周边 · 人工智能 | 6小时前 | Seedance2.0

- Seedance2.0打造爆款短视频技巧分享

- 175浏览 收藏

-

- 科技周边 · 人工智能 | 6小时前 |

- PerplexityAPI高负载死锁怎么解决

- 417浏览 收藏

-

- 科技周边 · 人工智能 | 6小时前 |

- 海量访谈笔录怎么整理?Kimi快速提取关键信息

- 413浏览 收藏

-

- 科技周边 · 人工智能 | 6小时前 |

- AI图标生成工具推荐及素材下载

- 167浏览 收藏

-

- 科技周边 · 人工智能 | 6小时前 | Perplexity

- Perplexity速读50页PDF教程

- 203浏览 收藏

-

- 科技周边 · 人工智能 | 6小时前 |

- 从脚本到视频,AI生成全过程揭秘

- 219浏览 收藏

-

- 科技周边 · 人工智能 | 6小时前 |

- HermesAgentCPU内存限制设置教程

- 429浏览 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 4391次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 4741次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 4620次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 6397次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 4997次使用

-

- GPT-4王者加冕!读图做题性能炸天,凭自己就能考上斯坦福

- 2023-04-25 501浏览

-

- 单块V100训练模型提速72倍!尤洋团队新成果获AAAI 2023杰出论文奖

- 2023-04-24 501浏览

-

- ChatGPT 真的会接管世界吗?

- 2023-04-13 501浏览

-

- VR的终极形态是「假眼」?Neuralink前联合创始人掏出新产品:科学之眼!

- 2023-04-30 501浏览

-

- 实现实时制造可视性优势有哪些?

- 2023-04-15 501浏览