golang如何实现mapreduce单进程版本详解

亲爱的编程学习爱好者,如果你点开了这篇文章,说明你对《golang如何实现mapreduce单进程版本详解》很感兴趣。本篇文章就来给大家详细解析一下,主要介绍一下MapReduce、单进程,希望所有认真读完的童鞋们,都有实质性的提高。

前言

MapReduce作为hadoop的编程框架,是工程师最常接触的部分,也是除去了网络环境和集群配 置之外对整个Job执行效率影响很大的部分,所以很有必要深入了解整个过程。元旦放假的第一天,在家没事干,用golang实现了一下mapreduce的单进程版本,github地址。处理对大文件统计最高频的10个单词,因为功能比较简单,所以设计没有解耦合。

本文先对mapreduce大体概念进行介绍,然后结合代码介绍一下,如果接下来几天有空,我会实现一下分布式高可用的mapreduce版本。下面话不多说了,来一起看看详细的介绍吧。

1. Mapreduce大体架构

上图是论文中mapreduce的大体架构。总的来说Mapreduce的思想就是分治思想:对数据进行分片,然后用mapper进行处理,以key-value形式输出中间文件;然后用reducer进行对mapper输出的中间文件进行合并:将key一致的合到一块,并输出结果文件;如果有需要,采用Combiner进行最后的合并。

归纳来说主要分为5部分:用户程序、Master、Mapper、Reducer、Combiner(上图未给出)。

- 用户程序。用户程序主要对输入数据进行分割,制定Mapper、Reducer、Combiner的代码。

- Master:中控系统。控制分发Mapper、Reduer的个数,比如生成m个进程处理Mapper,n个进程处理Reducer。其实对Master来说,Mapper和Reduer都属于worker,只不过跑的程序不一样,Mapper跑用户输入的map代码,Reduer跑用户输入的reduce代码。Master还作为管道负责中间路径传递,比如将Mapper生成的中间文件传递给Reduer,将Reduer生成的结果文件返回,或者传递给Combiner(如果有需要的话)。由于Master是单点,性能瓶颈,所以可以做集群:主备模式或者分布式模式。可以用zookeeper进行选主,用一些消息中间件进行数据同步。Master还可以进行一些策略处理:比如某个Worker执行时间特别长,很有可能卡住了,对分配给该Worker的数据重新分配给别的Worker执行,当然需要对多份数据返回去重处理。

- Mapper:负责将输入数据切成key-value格式。Mapper处理完后,将中间文件的路径告知Master,Master获悉后传递给Reduer进行后续处理。如果Mapper未处理完,或者已经处理完但是Reduer未读完其中间输出文件,分配给该Mapper的输入将重新被别的Mapper执行。

- Reducer: 接受Master发送的Mapper输出文件的消息,RPC读取文件并处理,并输出结果文件。n个Reduer将产生n个输出文件。

- Combiner: 做最后的归并处理,通常不需要。

总的来说,架构不复杂。组件间通信用啥都可以,比如RPC、HTTP或者私有协议等。

2. 实现代码介绍

该版本代码实现了单机单进程版本,Mapper、Reducer和Combiner的实现用协程goroutine实现,通信采用channel。代码写的比较随意,没有解耦合。

- 功能:统计给定文件中出现的最高频的10个单词

- 输入:大文件

- 输出:最高频的10个单词

- 实现:5个Mapper协程、2个Reducer、1个Combiner。

为了方便起见,Combiner对最高频的10个单词进行堆排序处理,按规范来说应该放在用户程序处理。

文件目录如下,其中bin文件夹下的big_input_file.txt为输入文件,可以调用generate下的main文件生成,caller文件为入口的用户程序,master目录下分别存放master、mapper、reducer、combiner代码:

. ├── README.md ├── bin │ └── file-store │ └── big_input_file.txt └── src ├── caller │ └── main.go ├── generate │ └── main.go └── master ├── combiner.go ├── mapper.go ├── master.go └── reducer.go 6 directories, 8 files

2.1 caller

用户程序,读入文件并按固定行数进行划分;然后调用master.Handle进行处理。

package main

import (

"os"

"path"

"path/filepath"

"bufio"

"strconv"

"master"

"github.com/vinllen/go-logger/logger"

)

const (

LIMIT int = 10000 // the limit line of every file

)

func main() {

curDir, err := filepath.Abs(filepath.Dir(os.Args[0]))

if err != nil {

logger.Error("Read path error: ", err.Error())

return

}

fileDir := path.Join(curDir, "file-store")

_ = os.Mkdir(fileDir, os.ModePerm)

// 1. read file

filename := "big_input_file.txt"

inputFile, err := os.Open(path.Join(fileDir, filename))

if err != nil {

logger.Error("Read inputFile error: ", err.Error())

return

}

defer inputFile.Close()

// 2. split inputFile into several pieces that every piece hold 100,000 lines

filePieceArr := []string{}

scanner := bufio.NewScanner(inputFile)

piece := 1

Outter:

for {

outputFilename := "input_piece_" + strconv.Itoa(piece)

outputFilePos := path.Join(fileDir, outputFilename)

filePieceArr = append(filePieceArr, outputFilePos)

outputFile, err := os.Create(outputFilePos)

if err != nil {

logger.Error("Split inputFile error: ", err.Error())

continue

}

defer outputFile.Close()

for cnt := 0; cnt

2.2 master

Master程序,依次生成Combiner、Reducer、Mapper,处理消息中转,输出最后结果。

package master

import (

"github.com/vinllen/go-logger/logger"

)

var (

MapChanIn chan MapInput // channel produced by master while consumed by mapper

MapChanOut chan string // channel produced by mapper while consumed by master

ReduceChanIn chan string // channel produced by master while consumed by reducer

ReduceChanOut chan string // channel produced by reducer while consumed by master

CombineChanIn chan string // channel produced by master while consumed by combiner

CombineChanOut chan []Item // channel produced by combiner while consumed by master

)

func Handle(inputArr []string, fileDir string) []Item {

logger.Info("handle called")

const(

mapperNumber int = 5

reducerNumber int = 2

)

MapChanIn = make(chan MapInput)

MapChanOut = make(chan string)

ReduceChanIn = make(chan string)

ReduceChanOut = make(chan string)

CombineChanIn = make(chan string)

CombineChanOut = make(chan []Item)

reduceJobNum := len(inputArr)

combineJobNum := reducerNumber

// start combiner

go combiner()

// start reducer

for i := 1; i

2.3 mapper

Mapper程序,读入并按key-value格式生成中间文件,告知Master。

package master

import (

"fmt"

"path"

"os"

"bufio"

"strconv"

"github.com/vinllen/go-logger/logger"

)

type MapInput struct {

Filename string

Nr int

}

func mapper(nr int, fileDir string) {

for {

val, ok :=

2.4 reducer

Reducer程序,读入Master传递过来的中间文件并归并。

package master

import (

"fmt"

"bufio"

"os"

"strconv"

"path"

"strings"

"github.com/vinllen/go-logger/logger"

)

func reducer(nr int, fileDir string) {

mp := make(map[string]int) // store the frequence of words

// read file and do reduce

for {

val, ok :=

2.5 combiner

Combiner程序,读入Master传递过来的Reducer结果文件并归并成一个,然后堆排序输出最高频的10个词语。

package master

import (

"fmt"

"strings"

"bufio"

"os"

"container/heap"

"strconv"

"github.com/vinllen/go-logger/logger"

)

type Item struct {

key string

val int

}

type PriorityQueue []*Item

func (pq PriorityQueue) Len() int {

return len(pq)

}

func (pq PriorityQueue) Less(i, j int) bool {

return pq[i].val > pq[j].val

}

func (pq PriorityQueue) Swap(i, j int) {

pq[i], pq[j] = pq[j], pq[i]

}

func (pq *PriorityQueue) Push(x interface{}) {

item := x.(*Item)

*pq = append(*pq, item)

}

func (pq *PriorityQueue) Pop() interface{} {

old := *pq

n := len(old)

item := old[n - 1]

*pq = old[0 : n - 1]

return item

}

func combiner() {

mp := make(map[string]int) // store the frequence of words

// read file and do combine

for {

val, ok := 0; i++ {

node := heap.Pop(&pq).(*Item)

res = append(res, *node)

}

CombineChanOut

3. 总结

不足以及未实现之处:

- 各模块间耦合性高

- master单点故障未扩展

- 未采用多进程实现,进程间采用RPC通信

- 未实现单个Workder时间过长,另起Worker执行任务的代码。

接下来要是有空,我会实现分布式高可用的代码,模块间采用RPC通讯。

好了,以上就是这篇文章的全部内容了,希望本文的内容对大家的学习或者工作具有一定的参考学习价值,如果有疑问大家可以留言交流,谢谢大家对golang学习网的支持。

今天关于《golang如何实现mapreduce单进程版本详解》的内容介绍就到此结束,如果有什么疑问或者建议,可以在golang学习网公众号下多多回复交流;文中若有不正之处,也希望回复留言以告知!

利用rpm打包上线部署golang代码的方法教程

利用rpm打包上线部署golang代码的方法教程

- 上一篇

- 利用rpm打包上线部署golang代码的方法教程

- 下一篇

- golang log4go的日志输出优化详解

-

- 痴情的钢笔

- 写的不错,一直没懂这个问题,但其实工作中常常有遇到...不过今天到这,帮助很大,总算是懂了,感谢博主分享博文!

- 2023-06-10 10:43:25

-

- 美满的荷花

- 这篇技术文章太及时了,细节满满,很好,已加入收藏夹了,关注大佬了!希望大佬能多写Golang相关的文章。

- 2023-05-26 05:44:19

-

- 欢呼的黑裤

- 很详细,mark,感谢博主的这篇文章内容,我会继续支持!

- 2023-01-20 12:57:16

-

- 妩媚的砖头

- 太给力了,一直没懂这个问题,但其实工作中常常有遇到...不过今天到这,看完之后很有帮助,总算是懂了,感谢大佬分享技术文章!

- 2023-01-19 03:32:25

-

- 端庄的小蚂蚁

- 这篇博文真及时,太全面了,受益颇多,码起来,关注作者了!希望作者能多写Golang相关的文章。

- 2023-01-05 12:07:55

-

- 发嗲的小蜜蜂

- 这篇文章内容太及时了,太细致了,受益颇多,收藏了,关注大佬了!希望大佬能多写Golang相关的文章。

- 2023-01-04 23:47:37

-

- 虚心的篮球

- 这篇技术文章真及时,楼主加油!

- 2023-01-04 04:10:20

-

- 无情的白猫

- 太全面了,码起来,感谢大佬的这篇博文,我会继续支持!

- 2023-01-03 10:46:14

-

- 忧郁的太阳

- 感谢大佬分享,一直没懂这个问题,但其实工作中常常有遇到...不过今天到这,帮助很大,总算是懂了,感谢up主分享博文!

- 2023-01-02 18:25:34

-

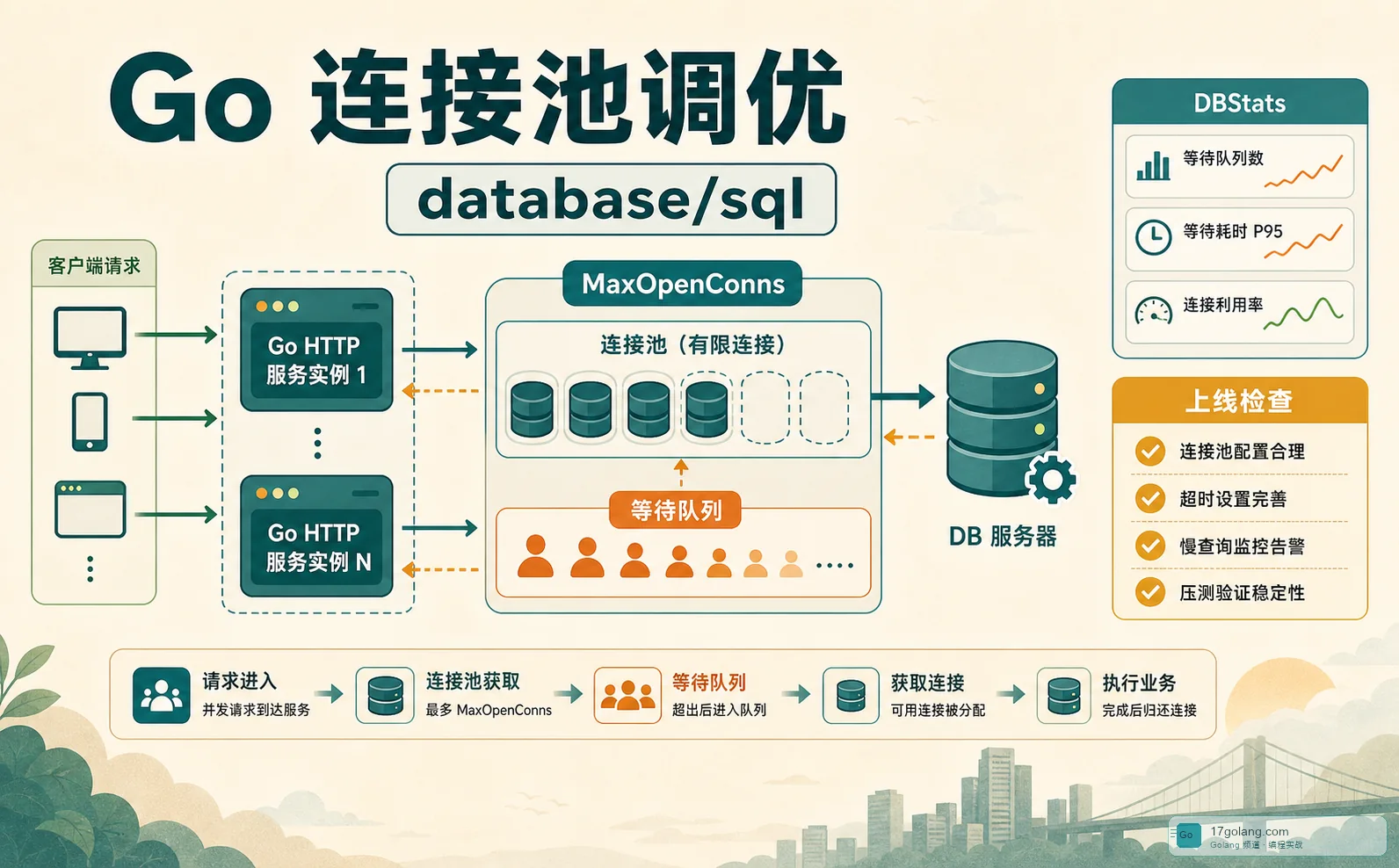

- Golang · Go教程 | 2天前 | 性能优化 · Go教程 · 后端工程 · Golang实战 · database/sql · 连接池调优 · golang Go 性能优化 连接池 MaxOpenConns database/sql 后端工程 DBStats

- Go database/sql 连接池实战:别让 MaxOpenConns 把接口拖成排队机

- 242浏览 收藏

-

- Golang · Go教程 | 2天前 | 并发编程 · 数据竞争 · Go教程 · 生产实践 · race detector · golang Go 数据竞争 并发 sync atomic race detector go test -race

- Go race detector 实战:别让数据竞争混进线上服务

- 147浏览 收藏

-

- 前端进阶之JavaScript设计模式

- 设计模式是开发人员在软件开发过程中面临一般问题时的解决方案,代表了最佳的实践。本课程的主打内容包括JS常见设计模式以及具体应用场景,打造一站式知识长龙服务,适合有JS基础的同学学习。

- 543次学习

-

- GO语言核心编程课程

- 本课程采用真实案例,全面具体可落地,从理论到实践,一步一步将GO核心编程技术、编程思想、底层实现融会贯通,使学习者贴近时代脉搏,做IT互联网时代的弄潮儿。

- 516次学习

-

- 简单聊聊mysql8与网络通信

- 如有问题加微信:Le-studyg;在课程中,我们将首先介绍MySQL8的新特性,包括性能优化、安全增强、新数据类型等,帮助学生快速熟悉MySQL8的最新功能。接着,我们将深入解析MySQL的网络通信机制,包括协议、连接管理、数据传输等,让

- 500次学习

-

- JavaScript正则表达式基础与实战

- 在任何一门编程语言中,正则表达式,都是一项重要的知识,它提供了高效的字符串匹配与捕获机制,可以极大的简化程序设计。

- 487次学习

-

- 从零制作响应式网站—Grid布局

- 本系列教程将展示从零制作一个假想的网络科技公司官网,分为导航,轮播,关于我们,成功案例,服务流程,团队介绍,数据部分,公司动态,底部信息等内容区块。网站整体采用CSSGrid布局,支持响应式,有流畅过渡和展现动画。

- 485次学习

-

- ChatExcel酷表

- ChatExcel酷表是由北京大学团队打造的Excel聊天机器人,用自然语言操控表格,简化数据处理,告别繁琐操作,提升工作效率!适用于学生、上班族及政府人员。

- 6267次使用

-

- Any绘本

- 探索Any绘本(anypicturebook.com/zh),一款开源免费的AI绘本创作工具,基于Google Gemini与Flux AI模型,让您轻松创作个性化绘本。适用于家庭、教育、创作等多种场景,零门槛,高自由度,技术透明,本地可控。

- 6683次使用

-

- 可赞AI

- 可赞AI,AI驱动的办公可视化智能工具,助您轻松实现文本与可视化元素高效转化。无论是智能文档生成、多格式文本解析,还是一键生成专业图表、脑图、知识卡片,可赞AI都能让信息处理更清晰高效。覆盖数据汇报、会议纪要、内容营销等全场景,大幅提升办公效率,降低专业门槛,是您提升工作效率的得力助手。

- 6480次使用

-

- 星月写作

- 星月写作是国内首款聚焦中文网络小说创作的AI辅助工具,解决网文作者从构思到变现的全流程痛点。AI扫榜、专属模板、全链路适配,助力新人快速上手,资深作者效率倍增。

- 8440次使用

-

- MagicLight

- MagicLight.ai是全球首款叙事驱动型AI动画视频创作平台,专注于解决从故事想法到完整动画的全流程痛点。它通过自研AI模型,保障角色、风格、场景高度一致性,让零动画经验者也能高效产出专业级叙事内容。广泛适用于独立创作者、动画工作室、教育机构及企业营销,助您轻松实现创意落地与商业化。

- 7111次使用

-

- golang并发工具MapReduce降低服务响应时间

- 2022-12-29 234浏览

-

- Golang编程并发工具库MapReduce使用实践

- 2022-12-27 257浏览